Apple iPhone Xs Max im Test: Maximum Telephonum

3/5Dual-Kamera mit viel SoC-Support

Das Aufnahmen mit dem iPhone Xs grundsätzlich anders aussehen als Fotos des iPhone X oder iPhone 8 (Plus) (Test), dessen Hauptkamera mit der des iPhone X übereinstimmt, liegt zum einen an Veränderungen bei Sensor und Linse, zum anderen tragen hier die angesprochenen Fähigkeiten des A12 Bionic entscheidend dazu bei.

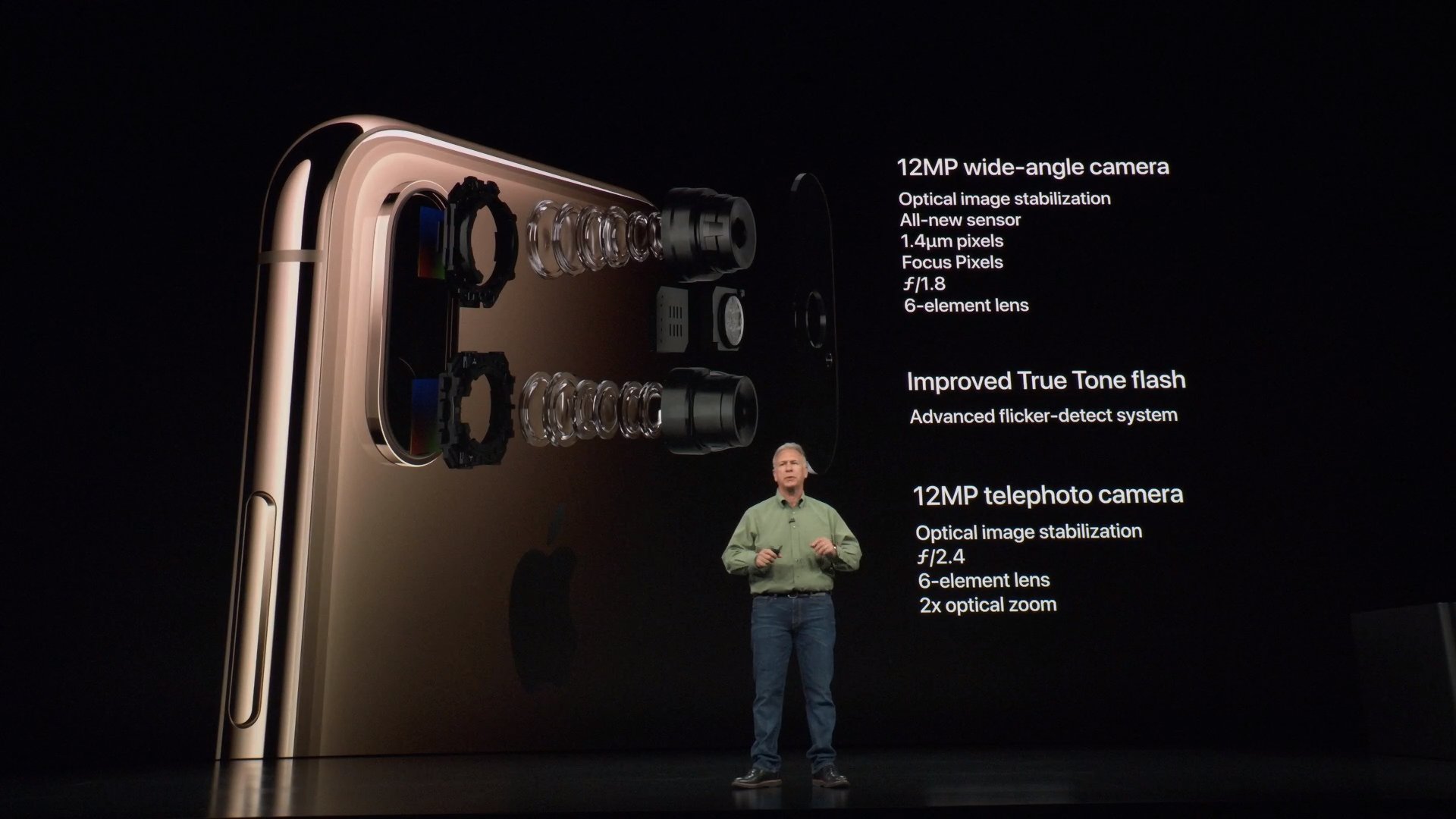

Zunächst einmal verbaut Apple für die Weitwinkelkamera einen neuen Sensor mit jetzt 1,4 statt 1,22 Mikrometer großen und zudem tieferen Pixeln. Der Sensor mit erneut 12 Megapixel ist 32 Prozent größer als der des iPhone X und iPhone 8 (Plus). Die Brennweite der f/1.8-Linse liegt nun bei 26 statt 28 mm Kleinbild-Äquivalent, sodass mit dem iPhone Xs bei gleichem Abstand zum Objekt etwas mehr Bildinformationen an den Rändern eingefangen werden. Am f/2.4-Teleobjektiv mit 52 mm Kleinbild-Äquivalent hat sich ebenso wie am dahinter liegenden Sensor mit 12 Megapixel nichts verändert. Über die zweite Linse ermöglicht Apple einen 2x optischen und 10x digitalen Zoom.

Face ID arbeitet zuverlässig

Auf der Vorderseite des Smartphones hat sich weniger verändert, hier soll ein neuer 7-Megapixel-Sensor lediglich schneller als bisher arbeiten. Gleiches gilt für Face ID, wobei hier nicht die Technik selbst überarbeitet wurde, sondern das Entsperren jetzt aufgrund des leistungsfähigeren A12 Bionic einen Hauch schneller vonstatten geht. Ein Direktvergleich mit einem iPhone X des Vorjahres war der Redaktion mangels Testgerät nicht möglich, Face ID arbeitete im Test jedoch in neun von zehn Fällen schnell und zuverlässig. Ob mit oder ohne Brille, Mütze auf dem Kopf oder morgens mit wilder Frisur und Zahnbürste im Mund: Face ID funktionierte stets wie von Apple beworben.

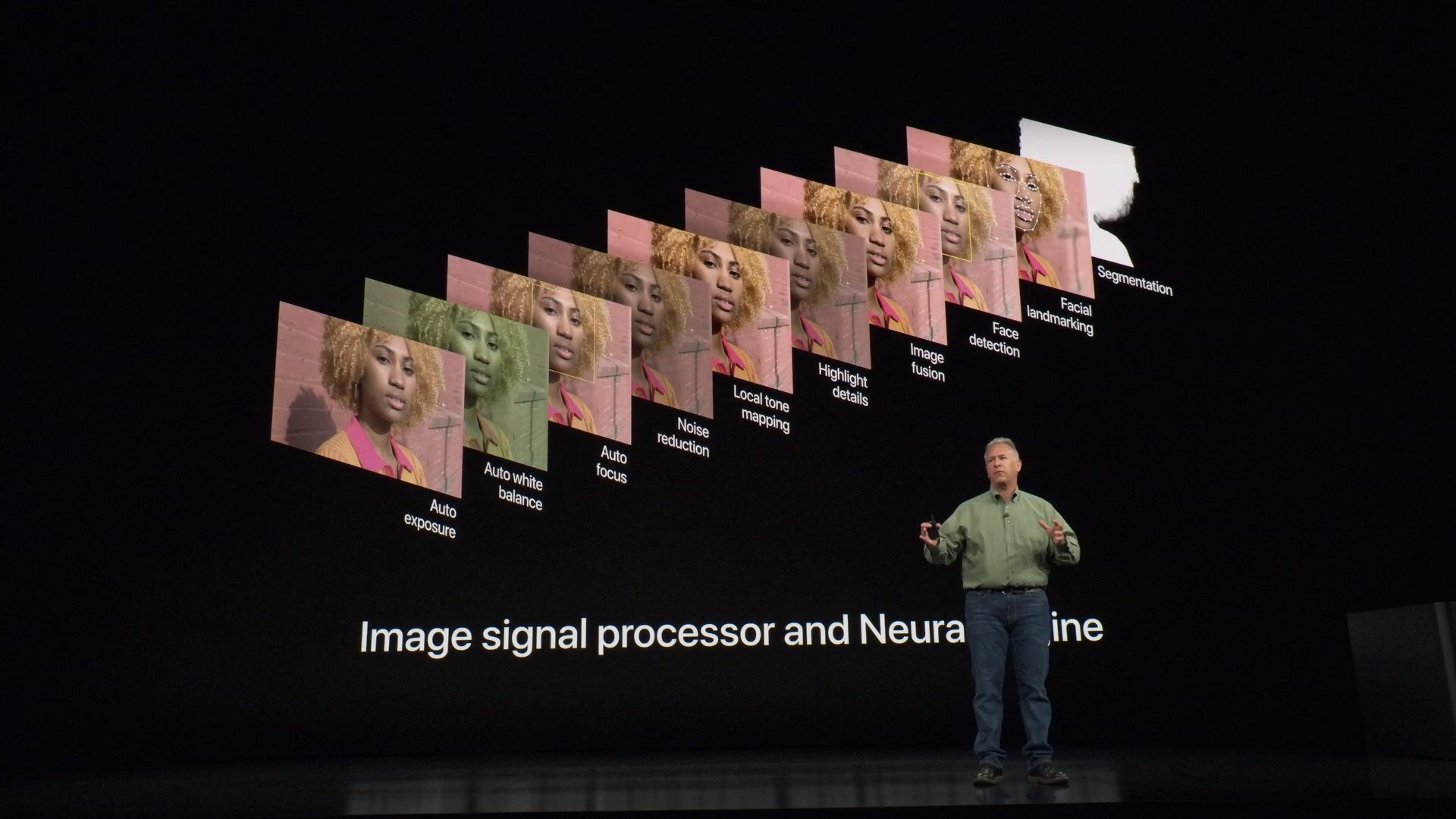

Im A12 Bionic sorgen CPU, Bildsignalprozessor und Neural Engine dafür, dass das Maximum aus Linsen und Sensor herausgeholt wird. Apple spricht von einer Billion Rechenoperationen für jedes einzelne Bild. Nach außen sichtbar werden diese Rechenoperationen über das neue Smart HDR und einen verbesserten Porträtmodus.

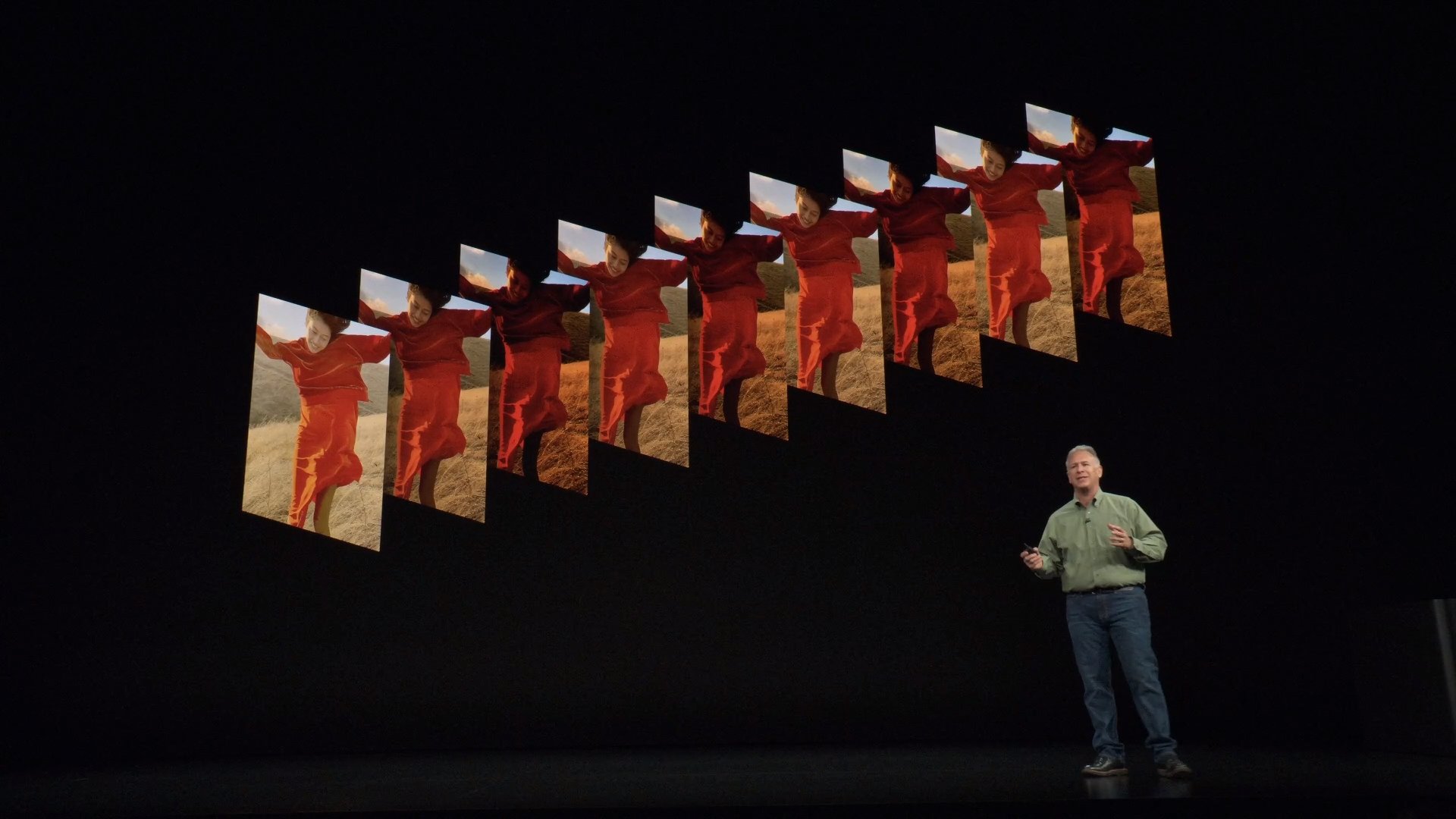

Das iPhone Xs nimmt bei geöffneter Kamera-App kontinuierlich Fotos auf und behält davon die letzten vier Aufnahmen im Buffer, damit beim Drücken des Auslösers sofort ein Bild auf dem Smartphone gespeichert werden kann. Dieses Feature nennt sich Zero-Shutter-Lag (Auslösen ohne Verzögerung) und stand schon bei früheren iPhone-Generationen zur Verfügung, ohne dass dies innerhalb der Kamera-App sichtbar ist.

Für das iPhone Xs kommen zu diesen vier im Buffer gehaltenen Aufnahme noch vier sogenannten Interframes hinzu, die mit einer kürzeren Belichtungszeit Highlights und Details aus sehr hellen Bereichen des Motivs zum Vorschein bringen. Darüber hinaus wird dieser „Bilderstapel“ durch eine überbelichtete Aufnahme ergänzt, die Highlights und Details aus dunklen Bildbereichen sichtbar macht. Von CPU, Bildsignalprozessor und Neural Engine werden daraufhin alle Aufnahmen analysiert und die jeweils besten Bereiche jedes Fotos zu einem finalen Foto zusammengefügt. Der Anwender bekommt davon nichts mit, Aufnahmen landen genau so schnell in der Galerie wie bisher.

Der Bildsignalprozessor übernimmt dank Unterstützung von CPU und Neural Engine jetzt aber nicht mehr nur Aufgaben wie Belichtungszeit, Autofokus, Weißabgleich, Rauschunterdrückung, Local Tone Mapping, Highlight- und Detail-Hervorhebung sowie die Bildzusammenlegung, sondern auch die Gesichtserkennung, das sogenannte Facial Landmarking für die Erkennung von Augen, Nase, Mund und weiteren Eigenschaften sowie die Segmentierung von Vordergrund und Hintergrund. Die neu hinzugekommenen Features sollen vor allem den Porträtmodus aufwerten, indem zum Beispiel rote Augen korrigiert und besser feine Details wie Haare vom Hintergrund getrennt werden.

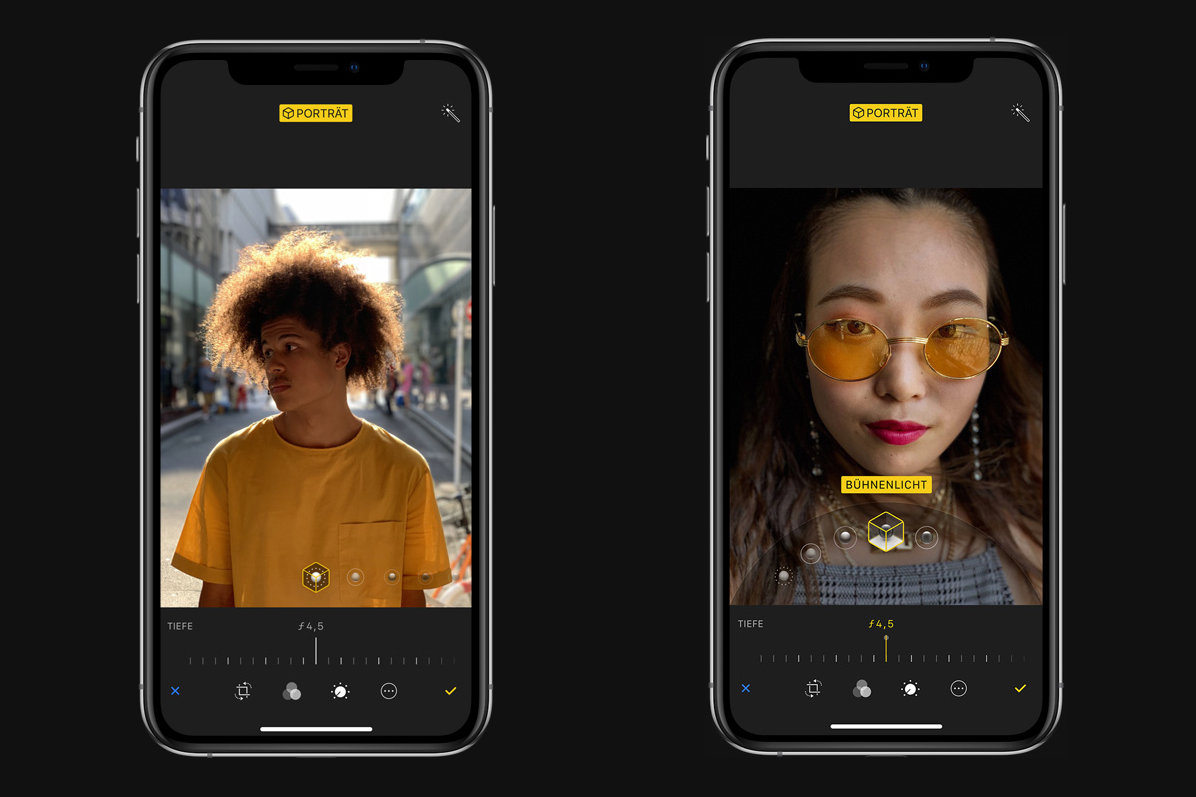

Porträtaufnahmen mit dem iPhone Xs sollen nicht nur besser aussehen, für den Anwender gibt es zudem eine neue Option in der Nachbearbeitung. Die Tiefenunschärfe (Bokeh) lässt sich nun beim Bearbeiten über die Fotos-App nachträglich zwischen simulierter Blende f/1.4 und f/16 verändern. Ausgehend von der f2.4-Linse des Teleobjektivs lässt sich der Effekt somit verstärken oder deutlich abschwächen. Apple behauptet, so etwas sei bisher mit noch keiner Kamera möglich gewesen, was jedoch schlicht und ergreifend nicht stimmt. Auf Smartphones von Huawei lässt sich die Tiefenunschärfe schon seit Jahren ebenfalls zwischen f/1.4 und f/16 verändern.

Fotos im Vergleich

Das iPhone Xs Max schießt durch die Bank bessere Fotos als das letztjährige iPhone 8 Plus, dessen Hauptkamera der des iPhone X und iPhone 8 entspricht. Apples neuer Smart-HDR-Modus sorgt dafür, dass grell beleuchtete Stellen im Foto reduziert und mehr Details eingefangen werden. Diese Bildcharakteristik zieht sich durch beinahe alle Aufnahmen, die zudem auch mit einem Google Pixel 2 (Test) und Samsung Galaxy Note 9 (Test) angefertigt wurden. Beispiele für Smart HDR sind die Eingangstür auf den Bildern 5 und 6, das Obst auf den Bildern 53 und 54 sowie sämtliche Beleuchtungen auf den Nachtaufnahmen. Gleichzeitig werden durch Smart HDR Bildinformationen aus dunklen Bereichen hervorgehoben. Hier kommt die einzelne Langzeitbelichtung zum Tragen, die Apple dem Bilderstapel hinzufügt. Beispiele dafür sind die Hauswand auf den Bildern 9 und 10, der Kiosk auf den Bildern 13 und 14, die Backsteine des Tunnels auf den Bildern 49 und 50 sowie die Roller vor der Hauswand auf den Bildern 73 und 74.

Da Apple im iPhone Xs Max einen größeren Sensor verbaut, kann zu höheren ISO-Werten und einer kürzeren Belichtungszeit gegriffen werden, ohne das Rauschen zu verstärken. Bisher haben Apple-Smartphones immer mit möglichst niedrigem ISO-Wert und längerer Belichtungszeit Fotos aufgenommen, beim iPhone Xs zeigt sich im Vergleich zum iPhone 8 Plus aber, dass Apple von dieser Vorgehensweise abgerückt ist. Diese Eigenschaft zieht sich durch alle Aufnahmen und kommt insbesondere bei Nachtaufnahmen zum Tragen, wo am Beispiel der Aufnahmen 61 und 62 nun mit ISO 640 und 1/25 Sekunden Belichtungszeit statt ISO 100 und 1/4 Sekunden Belichtungszeit gearbeitet wird. Stärkeres Rauschen ist dabei nicht in den Aufnahmen erkennbar.

Im Direktvergleich zwischen iPhone Xs Max, iPhone 8 Plus, Pixel 2 und Galaxy Note 9 bestätigt sich erneut das gute Abschneiden der neuen Kamera. Die neue Bildverarbeitung führt zu durchweg besseren Fotos, die dem iPhone 8 Plus klar überlegen sind. Eklatant besser als ein ein Jahr altes Pixel 2 ist die neue iPhone-Kamera jedoch nicht. Googles (noch) aktuelle Smartphone-Generation schießt mit nur einer Linse nach wie vor ansehnliche Fotos, die allerdings in dunklen Bildbereichen Details vermissen lassen. Dafür kommen die Pixel-2-Aufnahmen mit besonders knackigen Farben und einem gewissen Leuchten, das die andere Smartphones nicht bieten.

iPhone Xs Max, Pixel 2 und Galaxy Note 9 liefern häufig das gleiche Qualitätsniveau, unterm Strich schneiden das Apple- und Google-Smartphone aber etwas besser als das Samsung-Smartphone ab. Apple bietet in jedem Fall den größten Dynamikumfang und sehr ausgewogene Aufnahmen, Google hingegen etwas imposantere Aufnahmen, die einen Hauch zu dunkel erscheinen. Es ist ein Kopf-an-Kopf-Rennen, das an der Ziellinie durch feine persönliche Präferenzen als eine nüchterne Betrachtung entschieden wird.

Videoaufnahmen im Vergleich

Kleinere Anpassungen bietet das iPhone Xs auch bei Videoaufnahmen. Die hintere Kamera bietet einen erweiterten Dynamikbereich für Videoaufnahmen mit bis zu 30 FPS. Außerdem können die Bilder pro Sekunde in dunklen Umgebungen automatisch während einer Videoaufnahme auf bis zu 24 FPS reduziert werden, um für jeden Frame mehr Licht als mit 30 oder 60 FPS einzufangen. Erstmals sind mit einem iPhone zudem Videoaufnahmen mit Stereoton möglich.

Den erweiterten Dynamikbereich für Videoaufnahmen mit bis zu 30 FPS gibt es auch für die vordere Kamera, außerdem nimmt diese nun erstmals Full-HD-Videos mit 30 oder 60 FPS auf. Neu ist hier zudem die sogenannte Cinematic-Videostabilisierung, die in 720p und 1080p funktioniert. FaceTime-Videos oder Video-Selfie-Aufnahmen haben dadurch weniger Wackler.

Während es bei Fotoaufnahmen noch sehr eng zwischen aktuellen High-End-Smartphones zugeht, sind aktuelle Apple-Smartphones für Videoaufnahmen klar die besten Geräte. Mit der iPhone-Xs-Generation legt Apple hier noch einmal nach und überträgt den größeren Dynamikumfang auf die Videos, die dadurch noch eine Stufe besser aussehen. Erkennbar ist dies bereits zu Beginn des Videos an den Fenstern und Balkonen des Hauses im Hintergrund sowie ab Minute 0:18 anhand der Details in den Bäumen sowie den Ranken am Haus. Selbst hinter der getönten Rückscheibe des Autos am Straßenrand sind jetzt die Rücksitze erkennbar. Apples Kombination aus optischer Stabilisierung sowie der Cinematic-Videostabilisierung arbeitet zudem erneut sicher.

Dass iPhone Xs und Xs Max den Ton für Videoaufnahmen erstmals in Stereo aufnehmen, verdeutlichen zum Beispiel die vorbeifahrende Straßenbahn und ab Minute 0:35 die Unterhaltung der beiden Männer, die rechts an der Kamera vorbeilaufen und auf dem iPhone 8 Plus auf beiden Kanälen, auf dem iPhone Xs Max jedoch korrekt nur auf dem rechten Kanal zu hören sind. Es mag eine auf dem Papier vergleichsweise kleine Anpassung sein, doch der neue Stereoton ist für Videos ein großer Zugewinn.

Im Podcast erinnern sich Frank, Steffen und Jan daran, wie im Jahr 1999 alles begann.