Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

News Chipfertigung: Intel startet 7 nm mit GPU statt CPU im Jahr 2021

- Ersteller MichaG

- Erstellt am

- Zur News: Chipfertigung: Intel startet 7 nm mit GPU statt CPU im Jahr 2021

Naja, der 7nm-Prozess scheint bei Intel ja recht rund zu laufen  . Hatte sich aber eigentlich auch schon so angekündigt. Erinnere mich da an eine Aussage Intels vor ein paar Monaten.

. Hatte sich aber eigentlich auch schon so angekündigt. Erinnere mich da an eine Aussage Intels vor ein paar Monaten.

https://www.heise.de/newsticker/meldung/Intel-sieht-sich-bei-7-nm-Chips-im-Plan-4244480.html

Bin mal gespannt, welche Halbwertszeit der 10nm-Prozess bei Desktopprozessoren bei Intel haben wird. Da werd ich nicht wirklich schlau draus. Ende 2019/Anfang 2020 kommt ja erst mal Comet Lake, dann dürfte irgendwann (2 Hj. 2020?) Icelake aufschlagen und 2022 eine neue CPU in 7nm kommen, wenn ich die Folien richtig interpretiere.

Überhaupt etwas merkwürdig, daß die neuen Server-CPUs vor den Desktops rauskommen werden. Früher führte Intel eine feinere Fertigungstechnik zunächst im Desktop ein und dann erst bei den Servern .

.

Auch dürfte es spannend werden, wie es sich mit den Desktop-Mainboards bei Intel verhalten wird. So mich ich das sehe, soll der Z400 für Comet Lake, dann der Z495 für Ice-Lake 10nm kommen. Und dann für 7nm schon wieder ein neuer Chipsatz? Das wäre selbst für Intel eine krasse Nummer. Könnte mir deshalb durchaus vorstellen, daß er Z495-Chipsatz auch mit den kommenden 7nm-CPUs läuft. So wie beim P67-Chipsatz Sandy Bridge (32nm) und Ivy Bridge (22nm) gelaufen sind.

@yummycandy

Vielen Dank fürs Einstellung der ganzen Folien . War ne äußerst interessante "Frühstückslektüre". Hast ja praktisch die ganze Nacht durchgearbeitet - Respekt!

. War ne äußerst interessante "Frühstückslektüre". Hast ja praktisch die ganze Nacht durchgearbeitet - Respekt!

Wünsche nen tollen Start in den Donnerstag,

Ice

https://www.heise.de/newsticker/meldung/Intel-sieht-sich-bei-7-nm-Chips-im-Plan-4244480.html

Bin mal gespannt, welche Halbwertszeit der 10nm-Prozess bei Desktopprozessoren bei Intel haben wird. Da werd ich nicht wirklich schlau draus. Ende 2019/Anfang 2020 kommt ja erst mal Comet Lake, dann dürfte irgendwann (2 Hj. 2020?) Icelake aufschlagen und 2022 eine neue CPU in 7nm kommen, wenn ich die Folien richtig interpretiere.

Überhaupt etwas merkwürdig, daß die neuen Server-CPUs vor den Desktops rauskommen werden. Früher führte Intel eine feinere Fertigungstechnik zunächst im Desktop ein und dann erst bei den Servern

Auch dürfte es spannend werden, wie es sich mit den Desktop-Mainboards bei Intel verhalten wird. So mich ich das sehe, soll der Z400 für Comet Lake, dann der Z495 für Ice-Lake 10nm kommen. Und dann für 7nm schon wieder ein neuer Chipsatz? Das wäre selbst für Intel eine krasse Nummer. Könnte mir deshalb durchaus vorstellen, daß er Z495-Chipsatz auch mit den kommenden 7nm-CPUs läuft. So wie beim P67-Chipsatz Sandy Bridge (32nm) und Ivy Bridge (22nm) gelaufen sind.

@yummycandy

Vielen Dank fürs Einstellung der ganzen Folien

Wünsche nen tollen Start in den Donnerstag,

Ice

Zuletzt bearbeitet:

Waelder

Commander

- Registriert

- Juli 2012

- Beiträge

- 2.656

@SirSilent naja auf dem Papier waren sie immer Voraus im Gegensatz zur Realität...

Man darf gespannt sein ob da noch was wird - am Ende fertigen sie auch noch bei einem anderen Fertiger und nur noch die Chipsätze in den eignen Fabriken

Man darf gespannt sein ob da noch was wird - am Ende fertigen sie auch noch bei einem anderen Fertiger und nur noch die Chipsätze in den eignen Fabriken

yummycandy schrieb:Ach nein? Gestern von Intel veröffentlicht:

2016 ist aber nicht 2015.

Auf den 2011er Folien steht "1st production", damit sind i.d.R. die ersten funktionierenden Samples des Prozesses gemeint, z.B eine S-RAM Zelle, eine NAND-Zelle, eine Transistor.

Dass 10 nm deutlich zu spät ist steht ja außer Frage. Hast du gelesen, was auf der Folie unten drauf steht von "way too many risks"?

Muffknutscher

Lt. Commander

- Registriert

- Jan. 2007

- Beiträge

- 1.350

Bin ich der Einzige der da gewisse Parallelen sieht?

Warum? intel wird’s überleben.RYZ3N schrieb:Da kann einem Angst und Bange werden.

Und wenn Sie einen deep dive hinlegen, kann man einsteigen.

Ozmog

Rear Admiral

- Registriert

- März 2015

- Beiträge

- 5.403

Es würde sogar überhaupt Sinn manchen, wenn Intel (erstmal) nur GPGPUs raus bringt, weil im Compute-Bereich andere Maßstäbe bei angepasster Software ansetzen.

GPUs im Gaming aufzustellen ist ja schon etwas an, so verschieden schon AMD- und Nvidia-GPUs mit Spielen laufen, sowie Treiber Anpassungen für einzelne Spiele erhalten.

Dazu braucht Intel einen Nachfolger für Xeon Phi sowie eine Konkurrenz zu Nvidia Tesla. Im Compute ist auch mehr Geld zu holen, was auch eventuell schlechte Ausbeute zum Anfang gut abfangen könnte. Selbst wenn es bereits GPUs vorher in 10nm geben würde, treffen diese Vorteile zu. Aber dazu gab es meines Wissens noch keine offiziellen Aussagen.

Die Verzögerung von 10nm bewirkten das Ausreizen des 14nm-Prozesses auf ein hohes Takt Potential, damit kann man aber bei neuen Prozessen solche Taktraten nicht erreichen, sondern erst nach diversen Optimierungen. Der Erfolg von 14nm++ ist damit auch der Fluch zu gleich. Daher kommt so nach und nach in 10nm nur Mobile und später auch Server, Desktop benötigt aber für Relevanz eben annähernd so hohe Taktraten wie 14nm++, daher kommen Desktop-Prozessoren sehr spät und es könnte sich so weiter fortsetzen. Also 10nm+(+) im Desktop, während im Mobile bereits 7nm läuft, aber eben auch nicht die hohen Taktraten schafft, um im Desktop Relevanz zu erzeugen.

Kurz: Die Verzögerung von 10nm ist quasi doppelt schuld für die lange Nutzung von 14nm.

Auch wenn Intel 7nm nicht so komplex aufbauen will, glaube ich deren zeitliche Planung erst, wenn fertige Produkte den Markt erreichen.

Bei 7nm wird EUV mit eingeführt, was wiederum ein "neuer" Schritt bei Intel ist und wenn das heißt, dass 7nm komplett mit EHV belichtet wird, dann wird es doch wieder etwas komplexer. TSMC beispielsweise hat eine schrittweise Ranführung gewählt, also bei 7nm+ sind einige Schritte mit EUV und erst 5nm wird komplett auf EUV setzen. Sehen wir mal, wie es dann bei Intel so hinhaut. Eine große Stange Geld sind bewiesener Maßen kein Garant auf Erfolg, gerade Intel hat es in letzter Zeit häufiger bewiesen, neben 10nm eben auch mit Mobile-SoC und 5G-Modems als Beispiele. Genau wie auch schon Versuche in Richtung GPU gescheitert sind.

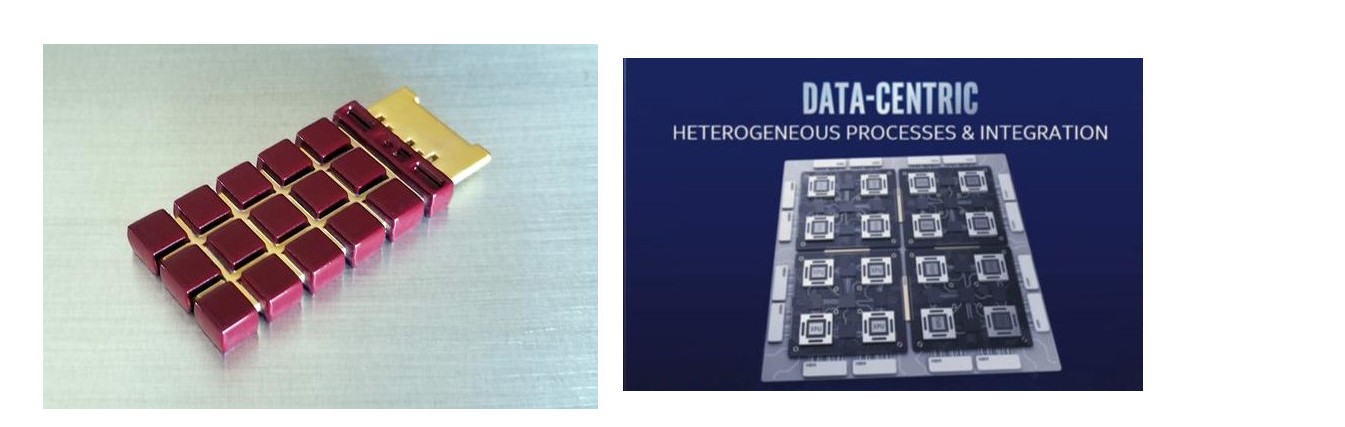

Zu ihrer Hochstapeltechnik ( ): Was wird man denn übereinander stapeln können? I/O unten, dazwischen vielleicht noch DRAM und oben müssen schon die PUs hin, also sowohl die CPU-Kerne als auch die GPU, sonst ist es thermisch kaum zu bändigen.

): Was wird man denn übereinander stapeln können? I/O unten, dazwischen vielleicht noch DRAM und oben müssen schon die PUs hin, also sowohl die CPU-Kerne als auch die GPU, sonst ist es thermisch kaum zu bändigen.

Immerhin bietet das schon einige Möglichkeiten auf geringer Fläche viel unterzubringen. Dürfte vor allem für Mobile interessant sein. Ein Mix an Prozessen ist hier sicher auch möglich.

Auch die Verbindung der einzelnen gestapelten Chiplets dürfte sich positiv auswirken. An sonsten ist es nicht so viel anders als bei AMD.

Wie das Stapel dann genau aussehen müsste, werden wir dann sehen, die einzelnen Dice müssten ja gleich groß ausfallen, was bei einigen Dice dann eventuell viel Leerfläche erfordert, weil die Schicht möglicherweise eben nicht so viel Fläche benötigt, wie eine andere.

Spannend bleibt das Thema aber auf jeden Fall. Wichtig ist aber, dass AMD noch einige Marktanteile abgräbt, da wir ansonsten in Gefahr laufen, wieder in Pre-Ryzen-Verhältnisse verfallen, mit hohen Preisen und wenig Anschub auf Verbesserung.

GPUs im Gaming aufzustellen ist ja schon etwas an, so verschieden schon AMD- und Nvidia-GPUs mit Spielen laufen, sowie Treiber Anpassungen für einzelne Spiele erhalten.

Dazu braucht Intel einen Nachfolger für Xeon Phi sowie eine Konkurrenz zu Nvidia Tesla. Im Compute ist auch mehr Geld zu holen, was auch eventuell schlechte Ausbeute zum Anfang gut abfangen könnte. Selbst wenn es bereits GPUs vorher in 10nm geben würde, treffen diese Vorteile zu. Aber dazu gab es meines Wissens noch keine offiziellen Aussagen.

Die Verzögerung von 10nm bewirkten das Ausreizen des 14nm-Prozesses auf ein hohes Takt Potential, damit kann man aber bei neuen Prozessen solche Taktraten nicht erreichen, sondern erst nach diversen Optimierungen. Der Erfolg von 14nm++ ist damit auch der Fluch zu gleich. Daher kommt so nach und nach in 10nm nur Mobile und später auch Server, Desktop benötigt aber für Relevanz eben annähernd so hohe Taktraten wie 14nm++, daher kommen Desktop-Prozessoren sehr spät und es könnte sich so weiter fortsetzen. Also 10nm+(+) im Desktop, während im Mobile bereits 7nm läuft, aber eben auch nicht die hohen Taktraten schafft, um im Desktop Relevanz zu erzeugen.

Kurz: Die Verzögerung von 10nm ist quasi doppelt schuld für die lange Nutzung von 14nm.

Auch wenn Intel 7nm nicht so komplex aufbauen will, glaube ich deren zeitliche Planung erst, wenn fertige Produkte den Markt erreichen.

Bei 7nm wird EUV mit eingeführt, was wiederum ein "neuer" Schritt bei Intel ist und wenn das heißt, dass 7nm komplett mit EHV belichtet wird, dann wird es doch wieder etwas komplexer. TSMC beispielsweise hat eine schrittweise Ranführung gewählt, also bei 7nm+ sind einige Schritte mit EUV und erst 5nm wird komplett auf EUV setzen. Sehen wir mal, wie es dann bei Intel so hinhaut. Eine große Stange Geld sind bewiesener Maßen kein Garant auf Erfolg, gerade Intel hat es in letzter Zeit häufiger bewiesen, neben 10nm eben auch mit Mobile-SoC und 5G-Modems als Beispiele. Genau wie auch schon Versuche in Richtung GPU gescheitert sind.

Zu ihrer Hochstapeltechnik (

Immerhin bietet das schon einige Möglichkeiten auf geringer Fläche viel unterzubringen. Dürfte vor allem für Mobile interessant sein. Ein Mix an Prozessen ist hier sicher auch möglich.

Auch die Verbindung der einzelnen gestapelten Chiplets dürfte sich positiv auswirken. An sonsten ist es nicht so viel anders als bei AMD.

Wie das Stapel dann genau aussehen müsste, werden wir dann sehen, die einzelnen Dice müssten ja gleich groß ausfallen, was bei einigen Dice dann eventuell viel Leerfläche erfordert, weil die Schicht möglicherweise eben nicht so viel Fläche benötigt, wie eine andere.

Spannend bleibt das Thema aber auf jeden Fall. Wichtig ist aber, dass AMD noch einige Marktanteile abgräbt, da wir ansonsten in Gefahr laufen, wieder in Pre-Ryzen-Verhältnisse verfallen, mit hohen Preisen und wenig Anschub auf Verbesserung.

S

smalM

Gast

Gleiche Tools, dieselben Designregeln wie bei N7, aber die Masken für die EUV-Layer sind natürlich nicht gleich.yummycandy schrieb:Es wird auch kein Zufall sein, daß TSMC noch den 6nm eingeschoben hat, der zum 7nm kompatibel ist (gleiche Masken usw.)

Die Kunden kommen ohne Redesign vom N7 zu einem EUV-Prozeß mit der damit einhergehenden verminderten Anzahl an Masken bzw. Produktionsschritten. Das ist dann ohne jeden Shrink, der benötigt nämlich doch ein Redesign. Der Knackpunkt dabei ist der reduzierte Aufwand gegenüber N7+. TSMC glaubt, daß alle N7-Kunden zu N6 wechseln werden, er wird also wahrscheinlich N7 irgendwann komplett ersetzen.

Im Übrigen soll N6 im 1. Quartal 2020 in die Risk-Production gehen, während N5 bereits im 2. Quartal 2020 in die Massenproduktion übergeht.

BTT:

Hmm, ist auf einer Intel-Folie vorher schon mal "vs TSMC" aufgetaucht?

Und hat man schon vorher auf Folie für 7nm die Skalierung von "x2" gesehen, statt "x2.4"?

Man hält also an der alten Folie mit der Skalierung von 10nm mit "x2.7" fest? Erinnert ein bißchen an die Angaben zum 14nm, die noch lange nachdem sie den Gate-Pitch zurücknehmen mußten, die ursprünglichen Werte auf den Folien zeigten...yummycandy schrieb:Ach nein? Gestern von Intel veröffentlicht

Zuletzt bearbeitet von einem Moderator:

konkretor

Vice Admiral

- Registriert

- März 2011

- Beiträge

- 6.650

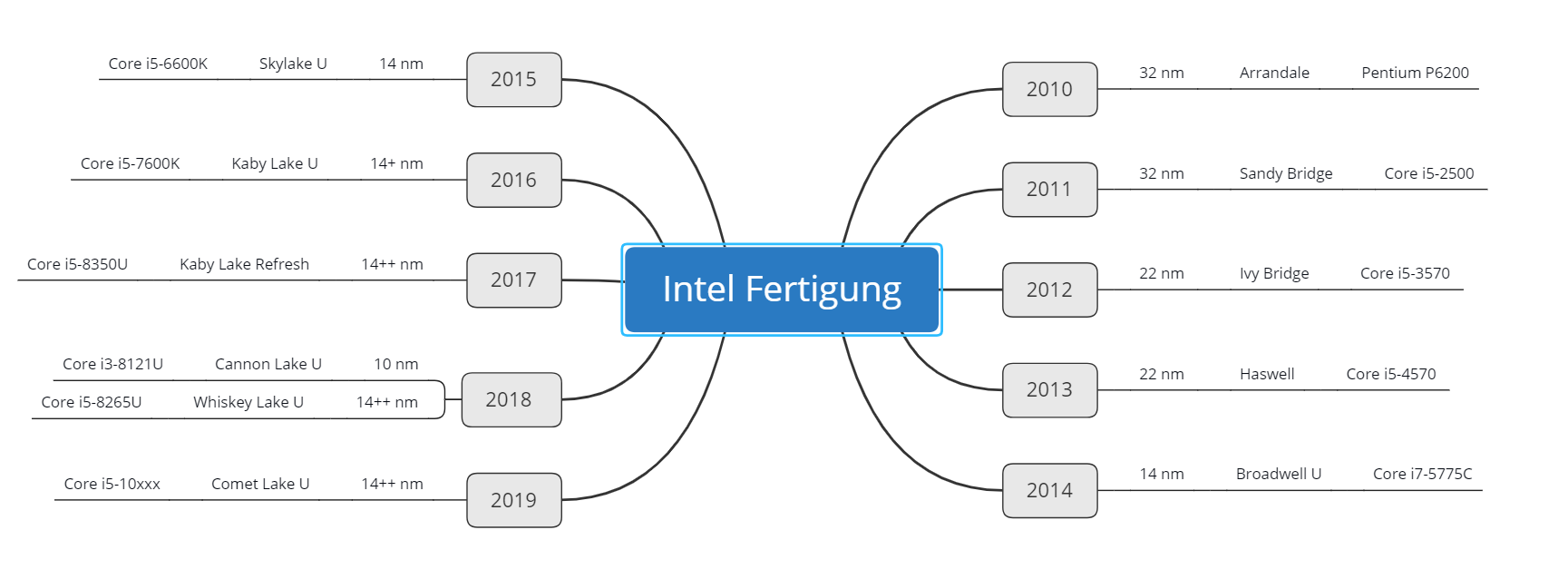

Ich hab mal versucht das Grafisch darzustellen, wie den der aktuelle Stand der Fertigung ist. Also wann wurde welches Verfahren in welchem Jahr verwendet. Ich blick ech nicht mehr durch, habe ich den Coffee Lake vergessen?

Habe auch immer versucht eine CPU zuzuordnen

!tilt!!!

Habe auch immer versucht eine CPU zuzuordnen

!tilt!!!

Dass das Sinn macht wollte ich auch gerad schreiben. Allerdings nicht aus technischer Sicht, sondern aus wirtschaftlicher. Denn Intel hat einen konkreten Zeitplan für den ersten US-Exascale Supercomputer der ebenfalls 2021 lautet. Die US-Regierung steckt eine halbe Milliarde $$$ in das Projekt Aurora. Die will und darf man halt nicht enttäuschen und vertrösten wie die gebeutelten 10nm Kunden. So ein Propaganda Projekt eines wichtigen Großkunden zu Zeiten von Trump dürfte noch deutlich größere Auswirkungen als nur das 500 Millionen Budget haben wenn es schief geht.rg88 schrieb:7nm erstmal nur für GPUs. Das macht absolut Sinn. Die Chips haben deutlich einfachere und gleichmäßigere Strukturen.

Ned Flanders

Fleet Admiral

- Registriert

- Aug. 2004

- Beiträge

- 11.412

Ich bin ja mal gespannt ob Intel überhaupt in den nächsten Jahren wieder an die Performance des 14nm +++ Prozess wird rankommen können. Egal in welchem Folgeprozess. Auch halte ich es für wenig wahrscheinlich, dass Intels Erstinkarnation des EUV Prozesses gleich mit dem 5nm TSMC Prozess wird mithalten können. Die spielen afaik schon erheblich länger damit.... aber who knwos...

[wege]mini

Banned

- Registriert

- Juli 2018

- Beiträge

- 8.357

Laberlohe schrieb:um zum Intel Investor Meeting/Day

es gibt einen punkt, da sind die unternehmen so groß, da trifft man sich mit investoren, die keine aktien kaufen.

wenn man frisches geld benötigt und wahlweise jemanden noch einen gefallen schuldet oder in der zukunft einen haben möchte, leiht man sich von ihm geld.

früher landete man dann im wucher zins. heute schuldet dir jemand einen gefallen,wenn du ihm 10% pro jahr für seine investition garantiert bezahlst.

mit reinen dividenden bei aktien landest du dort nicht. da muss man als investor wieder mit der wertsteigerung der aktie rechnen.

daher finde ich es immer wieder interessant, dass die informationen solcher veranstaltungen gerne mal in der öffentlichkeit gestreut werden (werbung)

über die wichtigen details redet doch dann keiner.....

mfg

Zuletzt bearbeitet:

v_ossi

Commodore

- Registriert

- Juni 2011

- Beiträge

- 4.785

Ozmog schrieb:[...]Zu ihrer Hochstapeltechnik (): Was wird man denn übereinander stapeln können? I/O unten, dazwischen vielleicht noch DRAM und oben müssen schon die PUs hin, also sowohl die CPU-Kerne als auch die GPU, sonst ist es thermisch kaum zu bändigen.

Immerhin bietet das schon einige Möglichkeiten auf geringer Fläche viel unterzubringen. Dürfte vor allem für Mobile interessant sein. Ein Mix an Prozessen ist hier sicher auch möglich.[...]

Bisschen kreativer bitte.

Da kann ich mir auch einen Chip mit I/O in 14nm unten, 1GB HBM darüber (als L4 Cache und für die IGPU), einer Lage reinem L3 Cache und erst oben drauf 4+2 asymmetrische CPU Kerne (in 10nm) und iGPU daneben vorstellen.

Ob's sinnvoll oder technisch umsetzbar wäre, steht auf einem anderen Blatt.

Aber immerhin sind mal wieder einige Gedankenspiele möglich.

SVΞN

Redakteur a.D.

- Registriert

- Juni 2007

- Beiträge

- 22.739

Ned Flanders schrieb:Ich bin ja mal gespannt ob Intel überhaupt in den nächsten Jahren wird an die Performance des 14nm +++ Prozess wird rankommen können.

Genau da sehe ich ebenfalls ein weiteres Problem und Intel scheint sich dessen auch bewusst zu sein.

Nicht ohne Grund wird man Comet Lake-S und Comet Lake-U weiterhin auf das 14-nm-Fertigungsverfahren setzen und selbst der CPU-Part von Rocket Lake-U soll noch in 14-nm gefertigt werden.

Intel wird versuchen die 14-nm-Fertigung so lange es irgendwie möglich ist, parallel laufen zu lassen.

Aber auch hier lässt sich einfach nicht viel mehr aus dem Skylake Re-Re-Refresh herausholen.

Die ersten [mobilen] 10-nm-Produkte werden zeigen wohin die Reise geht.

Ozmog

Rear Admiral

- Registriert

- März 2015

- Beiträge

- 5.403

An HBM hatte ich auch schon gedacht, aber ob das Funktioniert, die in Intels Stapel unterzubringen? Der Rest sind aber schon gute Gedankenspiele, statt des HBM eben einen D-RAM als L4 dürfte wahrscheinlicher werden. Oder eben doch HBM neben den Stapel, wer hindert den daran, nicht noch was daneben zu packen.v_ossi schrieb:Bisschen kreativer bitte.

[wege]mini

Banned

- Registriert

- Juli 2018

- Beiträge

- 8.357

RYZ3N schrieb:Intel wird versuchen die 14-nm-Fertigung so lange es irgendwie möglich ist, parallel laufen zu lassen.

es ist in jedem falle erst einmal wichtig, was man baut.

der 14nm+++ prozess ist wirklich gut. muss man auch mal anerkennen.

mit stapel design, ausgelagertem ram controler, chipleds bei cpu cores und gerne eine graka mit dem ganzen zusammen, kann man ja immer neben einander, über einander oder auch beides gemixed bauen.

der erste computer, der dann in mehreren zahlen als bits rechnet, muss ja auch quasi nur gebaut werden. ^^

und arme informatiker müssen software schreiben, welche diese monster füttert.

jeder, der schon einmal assembler gesehen hat, weiß wo von ich rede....

mfg

Ozmog

Rear Admiral

- Registriert

- März 2015

- Beiträge

- 5.403

RYZ3N schrieb:Intel wird versuchen die 14-nm-Fertigung so lange es irgendwie möglich ist, parallel laufen zu lassen

Im Prinzip genau anders herum: Intel wird 14nm so lange laufen lassen, bis folgende Prozesse diesen in Sachen Leistung übertrumpfen können.

Die wollen nicht zwangsläufig an 14nm++ fest halten, die müssen es.

SVΞN

Redakteur a.D.

- Registriert

- Juni 2007

- Beiträge

- 22.739

Ozmog schrieb:Die wollen nicht zwangsläufig an 14nm++ fest halten, die müssen es.

Das ist es, was ich damit auszudrücken versucht habe.

Im Grunde müssen sie an der 14-nm-Fertigung festhalten bis die 10-nm-Fertigung [und die 7-mm-Fertigung die ebenfalls ab 2021 parallel laufen soll] auf dem selben Leistungsniveau ist.

Deshalb ist such davon auszugehen, dass wir abseits des mobilen Sektors, bis weit in 2021 hinein Mainstream- und HEDT-CPUs in 14-nm sehen werden.

[wege]mini

Banned

- Registriert

- Juli 2018

- Beiträge

- 8.357

RYZ3N schrieb:Das ist es, was ich damit auszudrücken versucht habe.

und ich sage einfach nur, sie können es.

kosten, nutzen, leistung..... jetzt warten sie auf 7nm (läut schon im labor) und bis dahin verdienen sie immer noch gutes geld.

irgend wann ist dann die grenze erreicht. spätestens bei 5nm (konkurenz größe von "zahlen") muss man dann langsam reagieren...wenn also die 3nm langsam in sicht sind bei tsmc, MUSS intel am markt sein mit ihrem perfekt laufenden 7nm++ prozess und der 5nm "shrink" muss schon in den startlöchern sein.

bis dahin kann man die probleme des big-chip design´s lösen. das erhöht zu stark die kosten. lieber viele kleine - irgend wie zusammen gelötet, als einen großen mit viel nicht funktionierenden chips ← auch ein grund, warum man nicht auf 10nm wechselt, zu viel ausschuss.

hier hat amd mit ihrem design wirklich die nase vorne und intel ein wenig über rumpelt.

intel´s versuch mit "zusammen geklebten" chips endete damals ja beim pentium 4 eher kläglich.

mfg

Ähnliche Themen

- Antworten

- 25

- Aufrufe

- 9.922

- Antworten

- 303

- Aufrufe

- 47.529

- Antworten

- 273

- Aufrufe

- 135.179

- Antworten

- 60

- Aufrufe

- 10.711

- Antworten

- 38

- Aufrufe

- 7.806