Die Ratatouille-KI: Sicherheitsrisiken – Wenn der Agent fremden Befehlen folgt

4/4Was sich aber jetzt schon zeigt, sind die Sicherheitsrisiken, die mit den Agenten kommen. Ein wesentlicher Punkt neben technischen Schwachstellen: Menschen arbeiten oberhalb der eigenen Kompetenz- und Preisklasse, wie etwa die Meldungen von Nutzern zeigen, bei denen die autonomen Agenten sensible und wichtige Daten gelöscht haben. Selbst Metas AI-Security-Chef ist betroffen, bei ihr hat OpenClaw den Mail-Posteingang gelöscht.

- Meta Director of AI Safety Allows AI Agent to Accidentally Delete Her Inbox (404Media)

- Reddit-User entsetzt: Googles Coding-KI Antigravity löscht komplette Festplatte

- Moltbook: Das perfekte Setup für einen Sicherheitsalptraum (Golem)

- When two years of academic work vanished with a single click (Nature)

Es ist ein Kernproblem, das sich bereits in den Testläufen für diesen Artikel zeigt. Früher wurde man von technischen Dummheiten abgehalten, weil man sie schlicht nicht realisieren konnte. Nun fällt die technische Hürde weg. Man muss selbst überlegen, ob es wirklich sinnvoll ist, massenhaft Scraper auf Webdienste anzusetzen. Oder komplexe Webseiten- und App-Projekte umzusetzen, ohne eine Idee davon zu haben, welche Fallstricke unterwegs drohen können.

Das gilt umso mehr bei Coding-Assistenten, bei denen selbst Experten wie Willison oder Karpathy ab einem gewissen Punkt nicht mehr nachvollziehen können, wie die Agenten arbeiten.

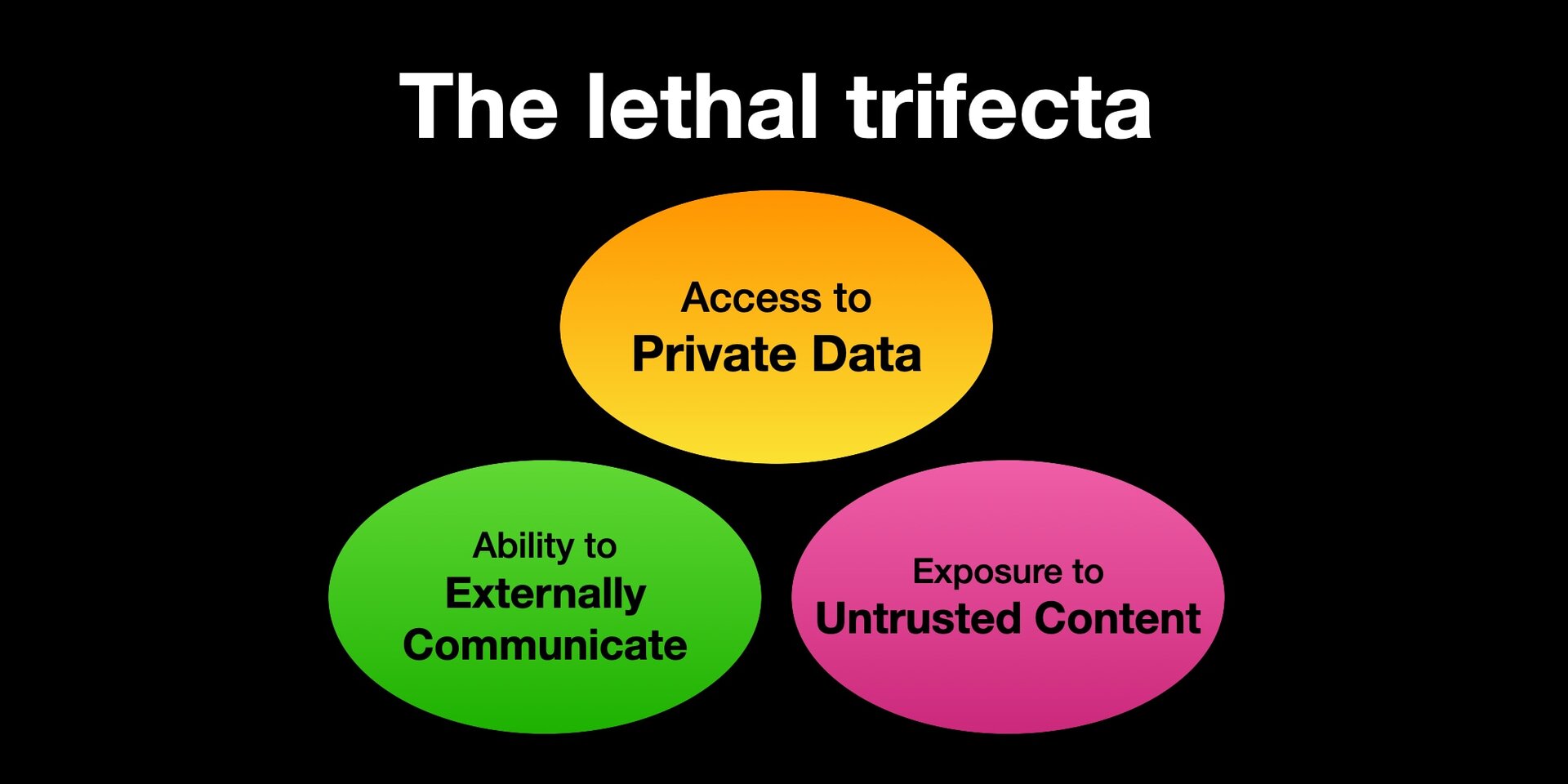

Das tödliche Dreigespann bei KI-Agenten

Um die Risiken zu greifen, nannte Simon Willison bereits im letzten Jahr drei Fähigkeiten von Agenten, die er im Zusammenspiel als Lethal Trifecta („tödliches Dreigespann“) bezeichnete. Dazu zählt er:

- Zugang zu den persönlichen Daten: Der Agent kann auf Inhalte zugreifen, die lokal gespeichert sind.

- Kontakt mit nicht-vertrauenswürdigen Inhalten: Möglich ist also, dass ein KI-System Inhalte auswertet, die von Fremden erstellt worden sind.

- Möglichkeit zur externen Kommunikation: Der Agent kann über Mail-Apps oder Messenger-Dienste Nachrichten versenden.

Der zentrale Angriffspunkt sind Prompt Injections, also heimliche Befehle, die den KI-Assistenten manipulieren sollen. „Jedes Mal, wenn man ein LLM-System bittet, eine Webseite zusammenzufassen, eine E-Mail zu lesen, ein Dokument zu verarbeiten oder sogar ein Bild zu betrachten, besteht die Möglichkeit, dass der Inhalt, den man ihm bereitstellt, zusätzliche Anweisungen enthält, die dazu führen, dass es etwas tut, das man nicht beabsichtigt hat“, so Willison.

Webseiten können also so manipuliert sein, dass ein Agent den Auftrag erhält, heimlich sensible Daten wie etwa Kontoinformationen oder Zugangsdaten zu versenden. Ein Problem ist das vor allem, wenn ein Agent weitreichende Zugriffsrechte hat und sich ziemlich autonom auf einem System bewegen kann. Eine Übersicht potenzieller Angriffswege liefern DeepMind-Forscher in einer Studie.

Nun versuchen Entwickler wie Anthropic und OpenAI, die Systeme gegen solche Attacken zu schützen. Wie anfällig die Agenten in der Praxis sind, demonstrierte der IT-Sicherheitsforscher Johann Rehberger in einem Vortrag auf dem 39C3.

Nochmals verschärft hat sich die Lage mit dem Open-Source-Agenten OpenClaw, den die IT-Sicherheitsforscher Sailesh Mishra und Sean P. Morgan vom Palo Alto Network als besonders kritisch bewerten. Neben mangelnden Schutzmechanismen vor Prompt Injections, die auch nur zögerlich behoben worden sind, verweisen die Autoren insbesondere auf einen weiteren Aspekt: Den dauerhaften Speicher („Persistent Memory“), durch den ein Agent bestimmte Informationen über Wochen und Monate im Gedächtnis behält. Was im Alltag dazu führt, dass auch bösartige Befehle dauerhaft erfasst bleiben.

OpenClaw has persistent memory, which means the malicious instructions hidden in a forwarded message are now available in its context even after a week. This exposes your system to a dangerous delayed multi-turn attack chain, which most system guardrails do not have the capability to detect and block.

Palo Alto Networks

Nun versuchen die KI-Entwickler, die Systeme gegen solche Angriffe abzusichern. Anthropic beschreibt mehrere Maßnahmen wie ein Sandboxing-Prozess, um den Raum zu begrenzen, in dem Claude Code arbeiten kann. Beschränkt ist der Schreibzugriff zudem auf die Verzeichnisse, die der Nutzer freigibt – für alles andere braucht es explizite Genehmigungen. Man will also sicherstellen, dass Nutzer die Kontrolle behalten.

Maßnahmen unterscheiden sich je nach Anwendung. Um Prompt Injections zu unterbinden, hat Google im November 2025 ein Konzept für KI-Browser vorgestellt, bei dem ein zweites KI-Modell im Hintergrund prüft, ob der Assistent tatsächlich die Befehle des Nutzers befolgt.

Was heißt das für den Privatnutzer? Dass Agenten mit neuen Sicherheitslücken einhergehen, erklärt auch KI-Unternehmer Herchenhein. Im Kern ist es aber nichts Neues. „Sicherheitslücken gab es vorher auch schon und natürlich muss ich Sicherheitsmaßnahmen ergreifen“, sagt er im Gespräch mit ComputerBase. Er empfiehlt, restriktiv mit Zugriffsberechtigungen umzugehen und bei Passwörtern eine 2-Faktor-Authentifizierung zu verwenden – das sind aber Standards, die heute schon gelten sollten.

Auch beim Einsatz autonomer KI-Systeme sollte man wissen, was man macht.

Welchen Leistungssprung die KI-Agenten wie Claude Code in den letzten Monaten gemacht haben, ist enorm. Bislang hatte ich immer den Eindruck, dass die KI-Assistenten der Faktor sind, der einem von Produktivitätsgewinnen abhält – zu unzuverlässig, zu langsam, zu umständlich, zu generisch. Nun fühlt sich an, als wäre eher meine Organisation der Knackpunkt. Je mehr ich also meine Arbeitsprozesse anpasse, desto mehr kann ich erreichen.

Klar ist aber: Das dauert. Nur weil der KI-Assistent jetzt etwa Excel-Tabellen mit erstaunlicher Zuverlässigkeit bearbeiten kann, heißt es nicht, dass plötzlich alles von allein läuft. Effizient sind die Tools vor allem, wenn man weiß, wo der Einsatz sinnvoll ist. Klar ist auch: Hier geht es um Büro-Aufgaben, also klassische White-Collar-Jobs. Einen Film dreht man damit nicht.

Schon die Anpassungsprobleme bei den Bürotätigkeiten sind ein Hinweis auf die Probleme, die kommen werden. Sicherheitslücken, Datenlecks, aus Versehen gelöschte Datenbestände – Experimente werden weiter schief gehen. Dazu noch gesellschaftliche Auswirkungen wie die Konsequenzen für den Arbeitsmarkt und das generelle Elend der Big-Tech-Welt. Es gibt genug Gründe, um keine Lust auf die Agenten zu haben und die KI-Entwicklung generell kritisch zu bewerten. Blickt man allein auf die Technologie, ist es aber schlicht faszinierend, was mittlerweile möglich ist.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.