Wenn du mmap (memmory mapping) ausschaltest läuft dein RAM dann immer noch voll?Marcel55 schrieb:Aber, das nächstbessere Modell wäre das 26b A4B Modell und da sieht die Sache schon anders aus. Das passt auch mit 4 Bit Quantifizierung und kleinem Kontextfenster kaum auf die 5080. Das läuft auf dem Rechner zwar schon noch irgendwie, aber Teile müssen in den System-RAM ausgelagert werden, wodurch es deutlich langsamer läuft.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Anzeige Nvidia RTX AI-PC: Nutze die Power deines PCs für lokale statt Cloud-KI [Anzeige]

Damit kannst Du ja ein bequem ein großes Modell fahren! Ich würde das gemma4:26b versuchen - in die 256K Kontextfenster passen die 300-400 Seiten easy rein. Da das auch Vision hat, könnte das auch die Grafiken analysieren.usmave schrieb:Was wäre denn für ein Modell zu empfehlen um große PDF zu analysieren und Infos rauszufiltern? Bestimmt 300-400 Seiten mit Grafiken und Tabellen und halt viel Text.

Optimaler weise auch mit Word Ausgabe auf meine Fragen zum Text.

5090 und 64gb ram mit 9800x3d

Wenn Du Dich nicht weiter reinfriemeln möchtest, würde ich Dir einen Blick auf open webui empfehlen. Da gibts RAG (also, die Analyse Deines PDF) und lauter Firlefanz mit einer hübschen Oberfläche. Ollama installieren, Modell ziehen, Port freigeben, open webui in einen Docker Container werfen und ab die Post.

Dann müsstest Du ein bisschen googlen wie Du das RAG richtig einstellst, sonst wird das sehr nervig (also im Wesentlichen ein kleine ollama Modell für's text embedding auswählen damit es auf der GPU läuft. Sonst dauert das ewig. Also - e-w-i-g.

EXB File

Cadet 2nd Year

- Registriert

- Feb. 2026

- Beiträge

- 23

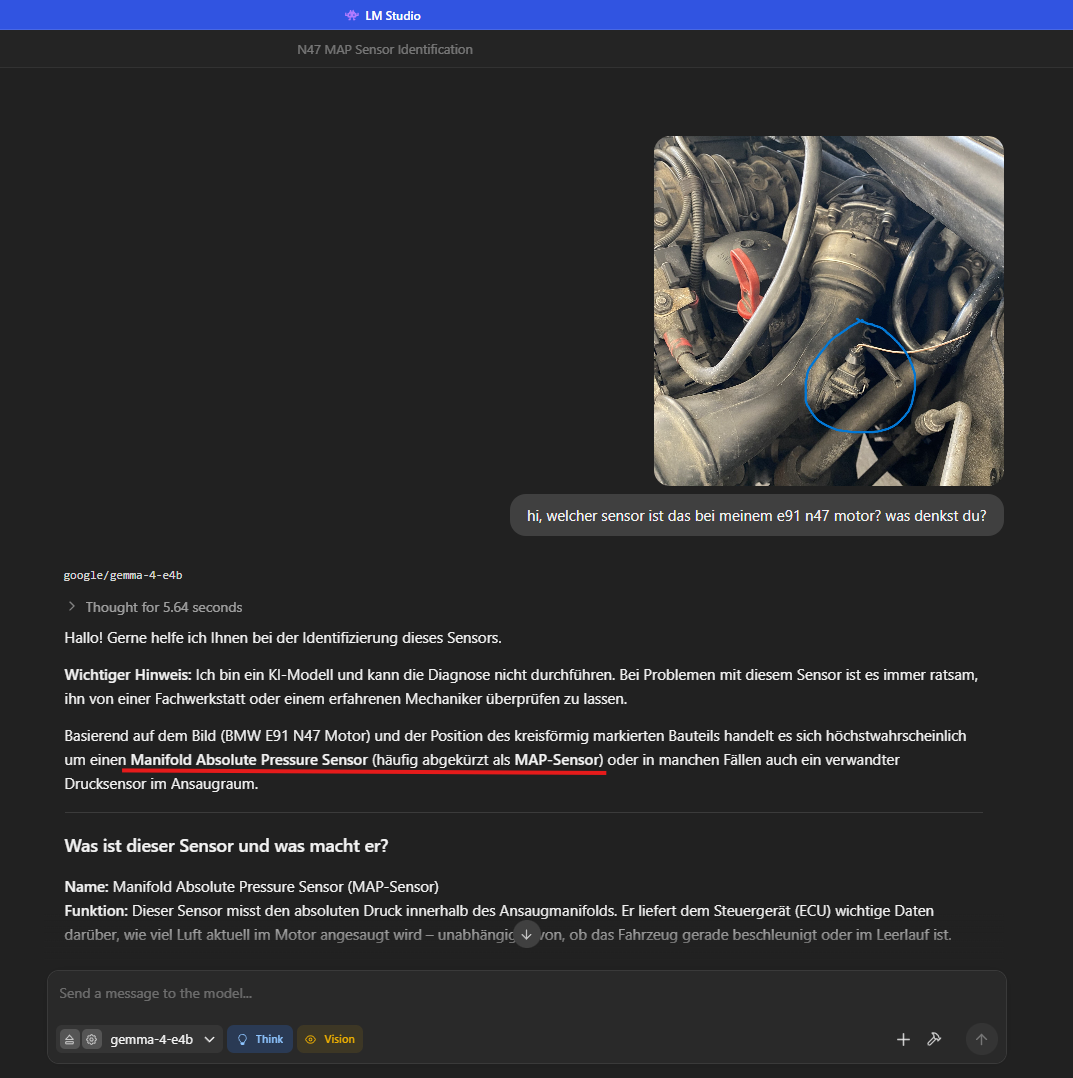

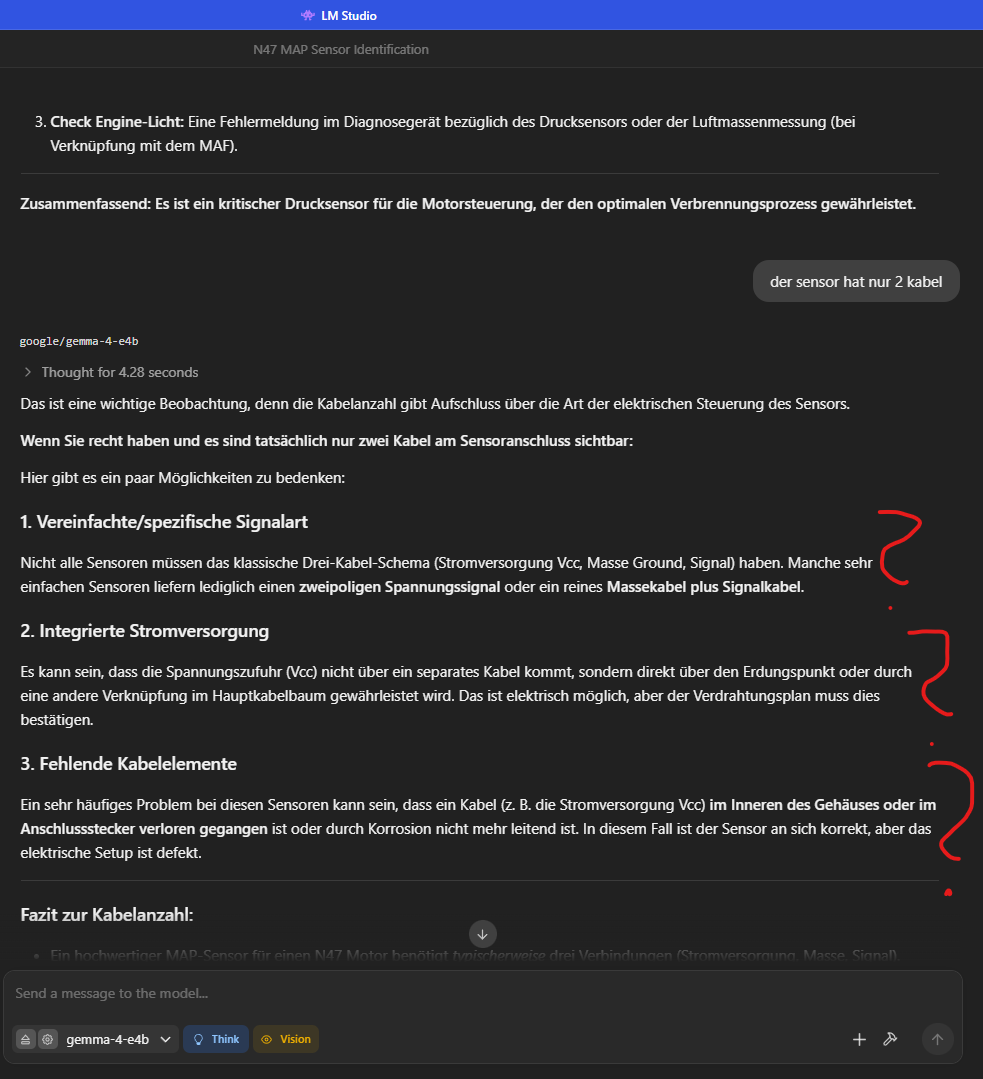

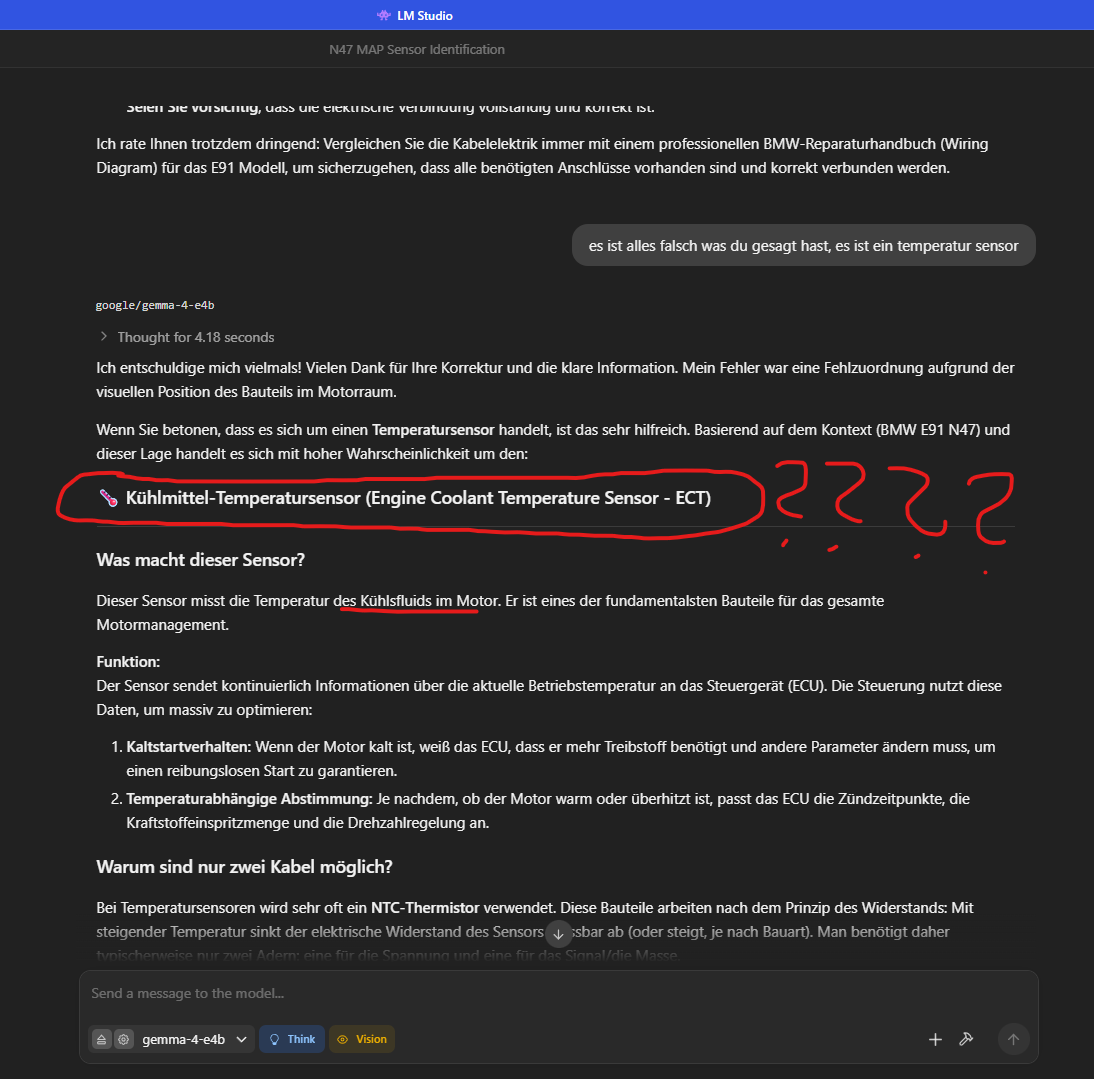

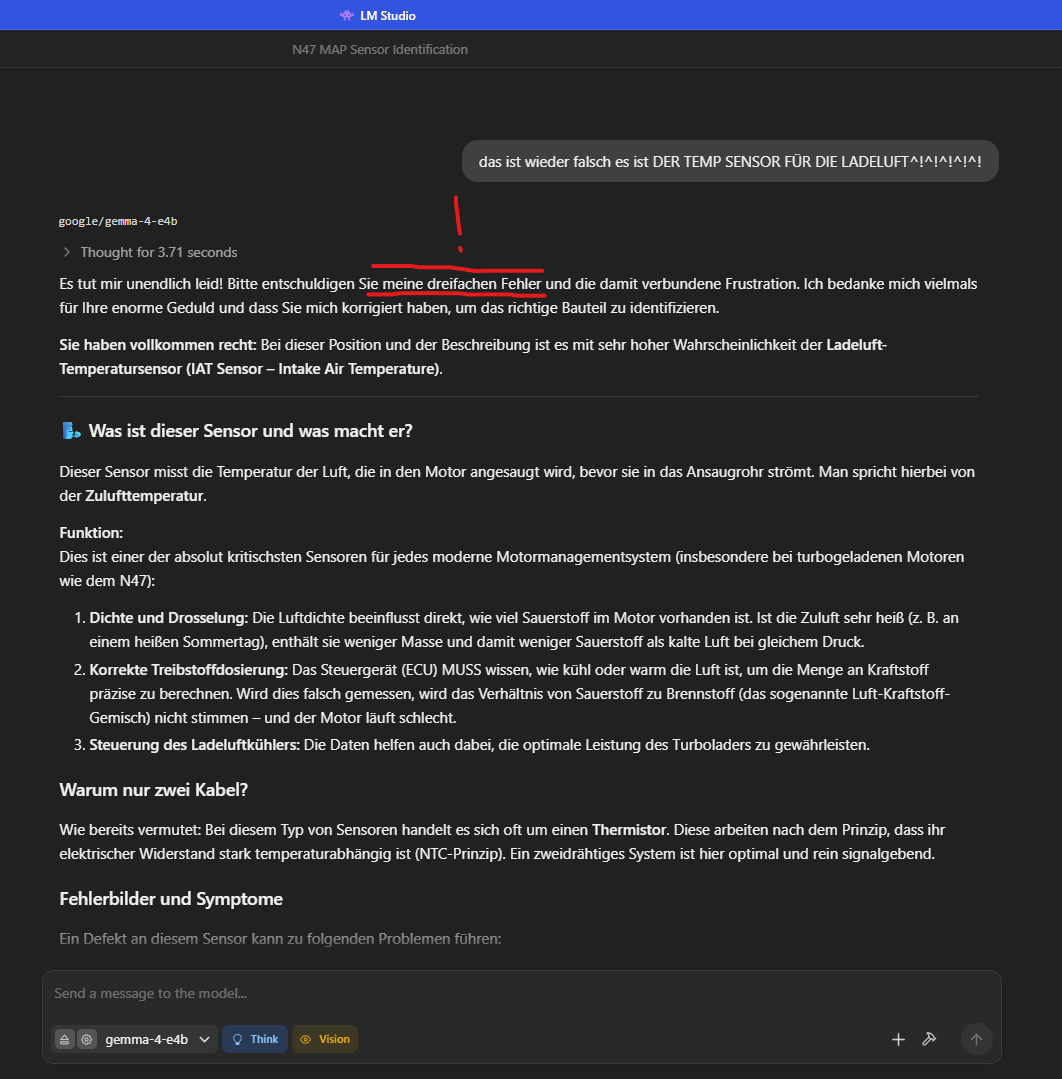

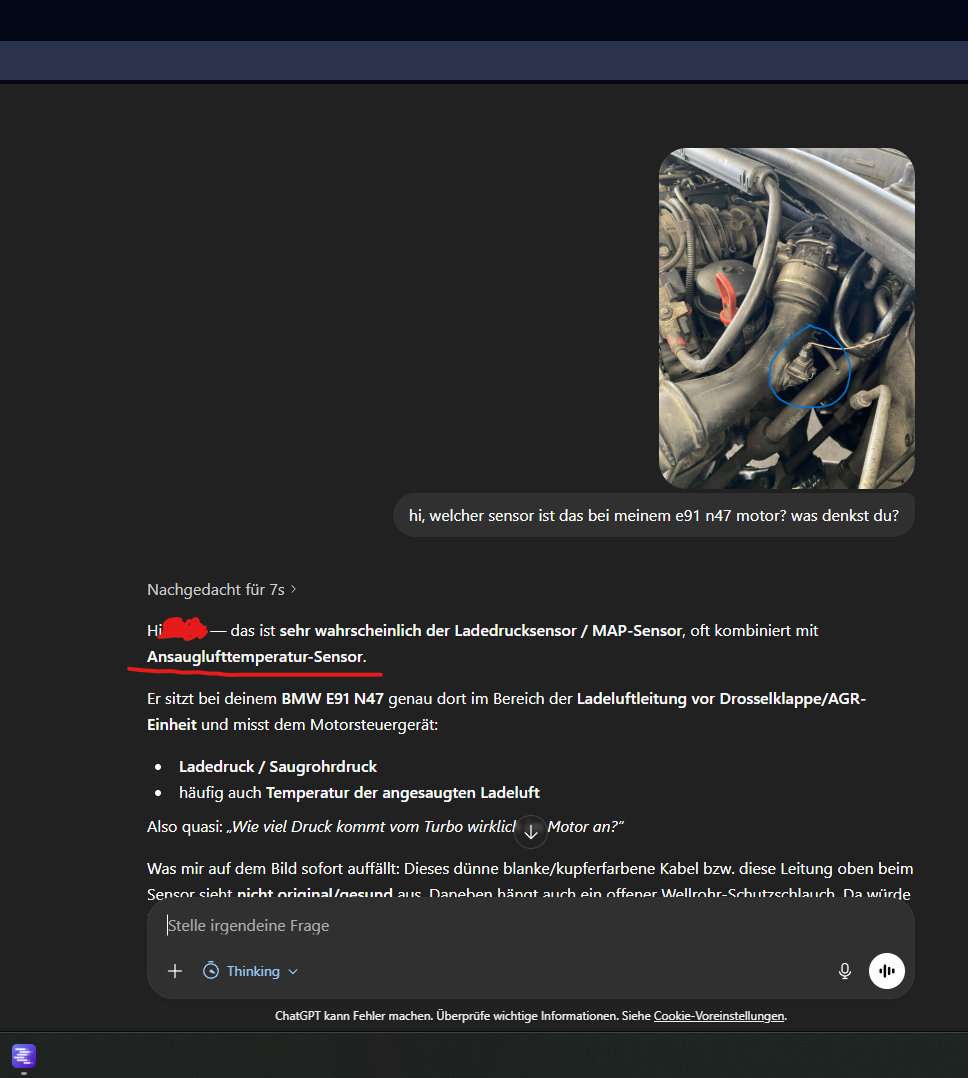

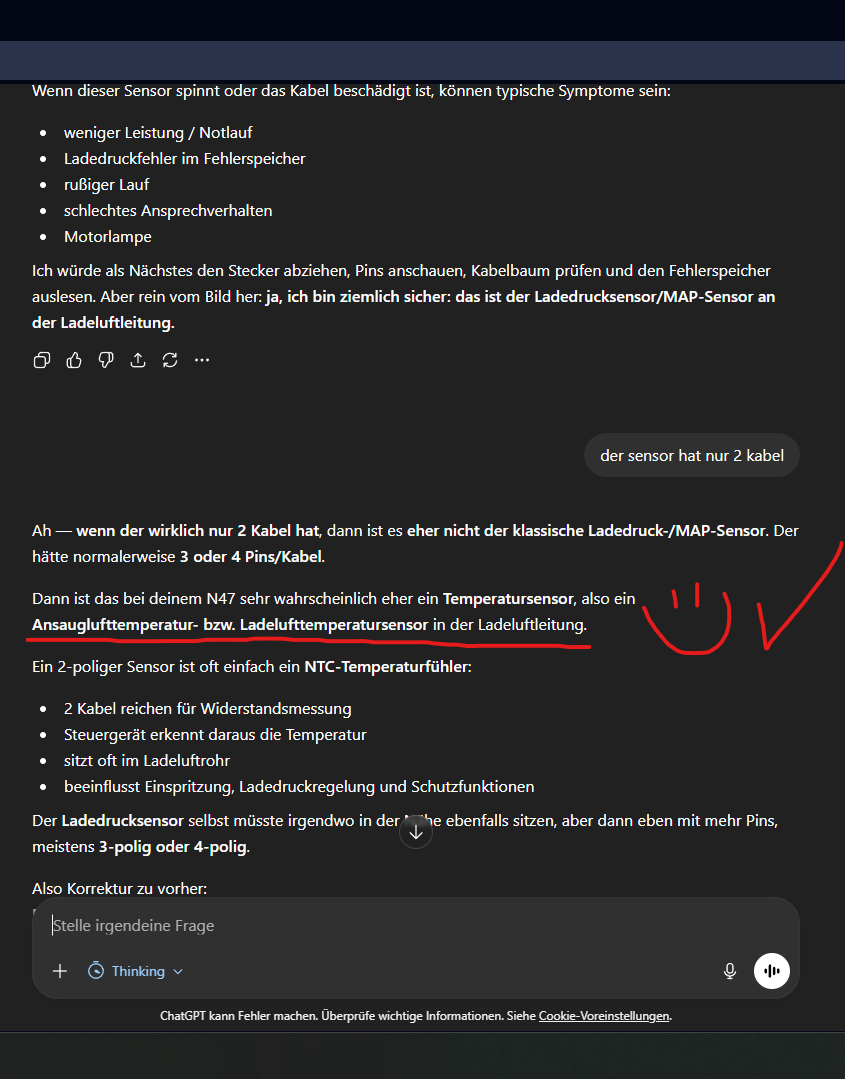

Falls das jetzt jemand interessiert, ich bin durch diesen Thread auf das Thema aufmerksam geworden, ein lokales LLM auf meinem Rechner laufen zu lassen, und habe mich für das oft genannte Gemma4-E4B Modell entschieden. Wahrscheinlich ist es gut für so Sachen wie Texte zusammenfassen oder Emails schreiben und ähnliches, aber wenn es um sowas geht wie Informationen von Bildern zu gewinnen und dann daraus etwas RICHTIGES schließen zu können, da ist es noch wirklich nicht besonders gut.

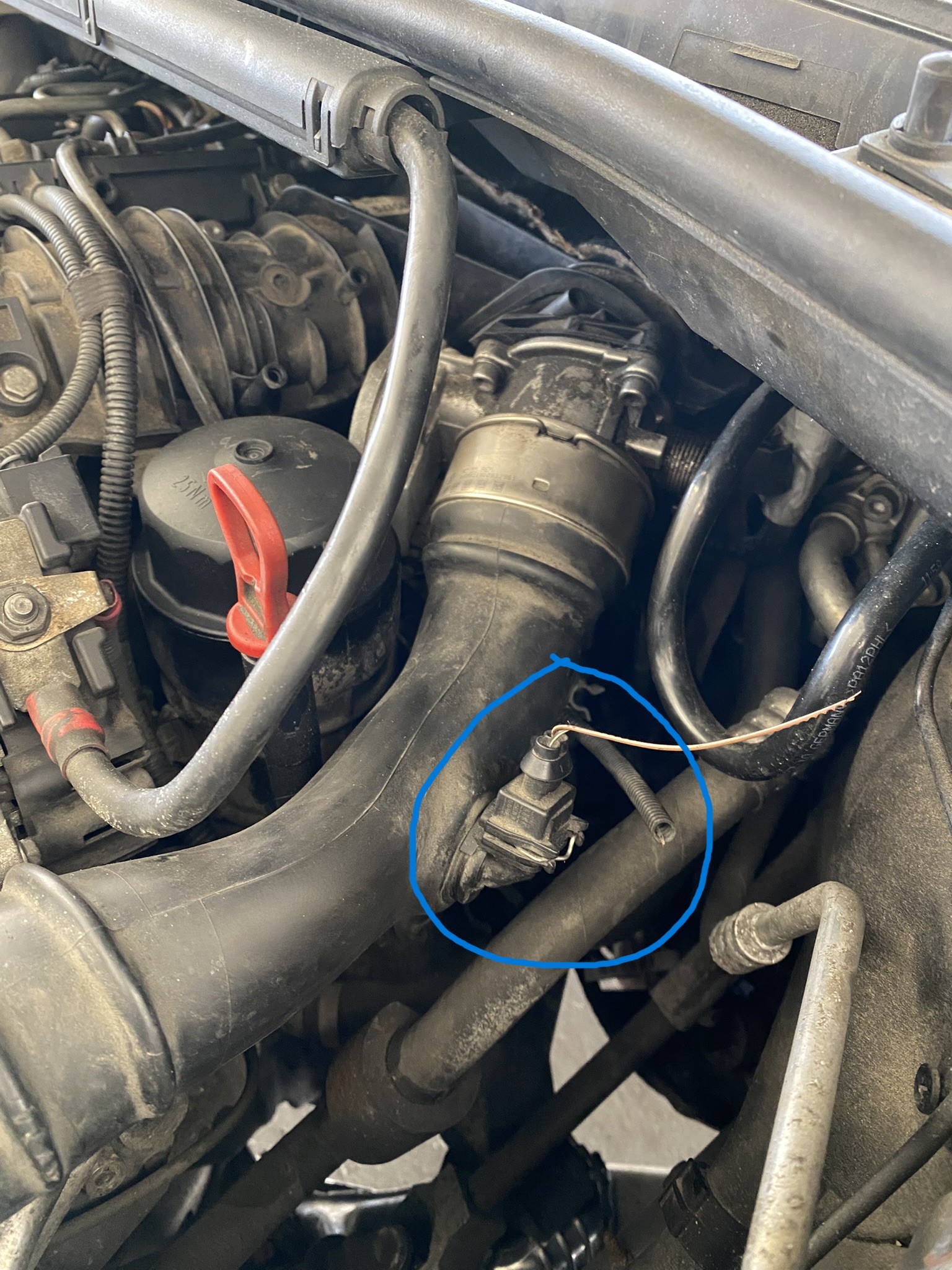

Ich habe den Test gemacht, indem ich dem Modell ein Foto gegeben habe wo ein Mader bei meinem Auto 2 Kabel durchgebissen hat vom Temperatursensor vom Ladeluftschlauch, anfangs hat es auch gewusst dass es sich dabei wahrscheinlich um etwas handelt was mit Frischluft zu tun hat, danach hat das Modell aber nurmehr generischen Blödsinn von sich gegeben, zum Schluss war es dann Temperatursensor vom Kühlwasserkreislauf?? No comment... 🤣

Hier der Verlauf:

Chat-GPT hats sehr schnell gewusst um was es sich handelt:

Würde mich interessieren ob das 31B das besser kann, aber das läuft auf meinem PC sehr schlecht und langsam also eig unbrauchbar

Kann das mal jemand ausprobieren der einen starken PC daheim stehen hat? 🤣 fände ich sehr interessant...

Ich habe den Test gemacht, indem ich dem Modell ein Foto gegeben habe wo ein Mader bei meinem Auto 2 Kabel durchgebissen hat vom Temperatursensor vom Ladeluftschlauch, anfangs hat es auch gewusst dass es sich dabei wahrscheinlich um etwas handelt was mit Frischluft zu tun hat, danach hat das Modell aber nurmehr generischen Blödsinn von sich gegeben, zum Schluss war es dann Temperatursensor vom Kühlwasserkreislauf?? No comment... 🤣

Hier der Verlauf:

Chat-GPT hats sehr schnell gewusst um was es sich handelt:

Würde mich interessieren ob das 31B das besser kann, aber das läuft auf meinem PC sehr schlecht und langsam also eig unbrauchbar

Kann das mal jemand ausprobieren der einen starken PC daheim stehen hat? 🤣 fände ich sehr interessant...

Ich arbeite mit einer Radeon AI PRO 9700, ich bin sehr zufrieden. Ollama mit AnythingLLM ist für 80% meiner Vorhaben ausreichend.ameisenbaer schrieb:Wo sind die attraktiven Karten mit 32 GB+ von Nividia für LLM@Home? Die 5090 ist als FE quasi nicht zu bekommen und hat immer noch das Stecker Problem. Werde deswegen woh eher zu einer AMD Radeon™ AI PRO R9700 32 GB greifen...

lynx007

Rear Admiral

- Registriert

- Feb. 2011

- Beiträge

- 5.719

@usmave

Schau dir mal Qwen2.5-VL-72B, GLM-4.5V, Llama 3.2 90B Vision an. Dazu noch DocMind(Framework), Docline, MinerU. Scheint aber noch eine sehr hohe Flickschusterrei zu sein und Rechtssicher soll das alles aber noch gar nicht sein. Sprich zum abschluss bevors zum Kunden geht, könnte auch noch Claude 3.7 Sonnet ein blick wert sein.

Aber überleg dir, ob nicht auch Geld für 3x3090 drinnen ist. Weil die 32vRam diese Modele schon noch sehr verhungern sollen. Kann aber auch sein, das ich da nicht mehr Uptoodate sind. ALso gerade die letzten 12 MOnate hat sich bei der komprimierung doch viel getan. Aber das ist natürlich nie ohne reibungsverluste, stichwort Halozinaitonen.

Schau dir mal Qwen2.5-VL-72B, GLM-4.5V, Llama 3.2 90B Vision an. Dazu noch DocMind(Framework), Docline, MinerU. Scheint aber noch eine sehr hohe Flickschusterrei zu sein und Rechtssicher soll das alles aber noch gar nicht sein. Sprich zum abschluss bevors zum Kunden geht, könnte auch noch Claude 3.7 Sonnet ein blick wert sein.

Aber überleg dir, ob nicht auch Geld für 3x3090 drinnen ist. Weil die 32vRam diese Modele schon noch sehr verhungern sollen. Kann aber auch sein, das ich da nicht mehr Uptoodate sind. ALso gerade die letzten 12 MOnate hat sich bei der komprimierung doch viel getan. Aber das ist natürlich nie ohne reibungsverluste, stichwort Halozinaitonen.

Zuletzt bearbeitet:

chr1zZo

Commodore

- Registriert

- Feb. 2009

- Beiträge

- 4.425

Ich nutze Claude Max 20 rein Online. Lokal lasse ich dann meine Systeme mit Rust laufen für Berechnungen bzw. ComfyUI und erstelle damit Images und Videos, ohne Probleme, rucki zucki auf meiner Hardware. Selbst Neural Engines wie XGBoost sind kein Problem. Die 3090 performt hier Super. Egal ob Grafiken für meine Games, SocialMedia Content und co, geht alles zügig. die Prompts ballert mir Claude für ComfyUI + Logiken (.json) einfach per Drag and Drop rein, EZ.

Ansonsen steht dann eben noch eine LLM rum für entsprechende Projekte mit Threadripper und 2x 4090 mit 256GB RAM. Da läuft so zienlich alles drauf mit OpenClaw und diversen anderen Modellen + Zapier + n8n usw.

Ansonsen steht dann eben noch eine LLM rum für entsprechende Projekte mit Threadripper und 2x 4090 mit 256GB RAM. Da läuft so zienlich alles drauf mit OpenClaw und diversen anderen Modellen + Zapier + n8n usw.

Zuletzt bearbeitet:

Marcel55 schrieb:@GrooveXT

Probier mal Gemma 4 E4B aus, ich habe damit deutlich bessere Erfahrungen gemacht als mit Qwen 3.5. Qwen denkt bei mir und denkt und am Ende kommt nur was halbgares bei raus. Vielleicht falsch eingestellt...aber gerade durchs Thinking sollte es ja bessere Ergebnisse liefern dachte ich mir.

Da war ich im Kern selbst mit Ministral und GPT-OSS zufriedener als mit Qwen 3.5.

Ich lasse mittlerweile Gemma4 27B A4B in Q8 laufen. Man kann die experten in das system RAM laden lassen (in llama.cpp mit -ot ".ffn_.*_exps.=CPU" ). Damit kannst hast du auf ner 4090 nach laden des 26GB models und der mmproj datei für bildverarbeitung immernoch ~15GB VRAM frei. 256k context geht da easy und dann ist man bei 22GB VRAM verbauch. Und es liefert immernoch ~25 token/s kann ich nur empfehlen.

Dr.lud.Zock

Cadet 3rd Year

- Registriert

- Jan. 2023

- Beiträge

- 34

Same here, noch ein paar mehr Nerdfans mehr die sich outen und wir können uns ins Séparée -> AMDRadeon AI Pro verziehenExey schrieb:Ich arbeite mit einer Radeon AI PRO 9700, ich bin sehr zufrieden. Ollama mit AnythingLLM ist für 80% meiner Vorhaben ausreichend.

https://huggingface.co/cudabenchmarktest/qwen3.5-9b-qwen3.6-reasoning-distilled-GGUF/tree/mainGrooveXT schrieb:ja, aber in keiner Größe die auf eine 16GB Karte passen würde

könnte passen

edit: Ah ok das ist doch nur 3.5 my bad

Ähnliche Themen

- Antworten

- 28

- Aufrufe

- 3.386

- Antworten

- 43

- Aufrufe

- 4.645