Nvidia RTX AI-PC: Nutze die Power deines PCs für lokale statt Cloud-KI [Anzeige]

![Nvidia RTX AI-PC: Nutze die Power deines PCs für lokale statt Cloud-KI [Anzeige]](https://pics.computerbase.de/1/2/1/9/3/3-3de112f3bed1c659/article-1280x720.701f4e8b.jpg)

Für viele ist der Griff zur AI mit dem Gang in die Cloud und damit oftmals mit Datenschutzbedenken oder Abogebühren verknüpft. Mit Nvidias RTX AI-PCs lassen sich KI-Anwendungen aber auch lokal auf dem Desktop-PC oder Notebook ausführen. Die KI-Bildgenerierung mit ComfyUI + FLUX.2 und OpenClaw als KI-Assistent sind Beispiele.

Nvidia RTX AI-PCs im Überblick

Nvidias RTX AI-PCs, ob als Desktop oder Notebook, sind mit aktuellen Grafikkarten vom Typ Nvidia GeForce RTX oder Nvidia RTX perfekt für die Ausführung von lokalen AI-Anwendungen geeignet und das hat zwei wesentliche Gründe:

- Die Hardware, die mit der FP4-Fähigkeit von Nvidia Blackwell (zum Beispiel GeForce RTX 5000) eine weitere deutliche Aufwertung erfahren hat.

- Der breite Ökosystem-Support, der auf Nvidia CUDA und TensorRT fußt. Über 1.500 Workloads können schon heute auf RTX AI-PCs beschleunigt werden (Stand April 2026).

Aber was konkret ist damit abseits von NVIDIA DLSS, der ersten Consumer-KI-Anwendung von Nvidia überhaupt, möglich? Zuletzt hatte sich diese Artikel-Serie bereits der KI-Beschleunigung von Kreativ-Apps sowie der Entwicklung eigener KI-Anwendungen Mithilfe von NVIDIA NIM und Blueprint beschäftigt:

- Blackwell RTX AI PCs: Das Powerhouse für KI- und Kreativ-Workflows [Anzeige]

- Nvidia NIM & Blueprint: KI-Modelle einfach auf RTX AI-PCs ausführen [Anzeige]

Dieses Mal geht es um die KI-Bildgenerierung mit FLUX und die Einrichtung eines KI-Assistenten mit OpenClaw, der zum Schutz der eigenen Daten lokal und nicht in der Cloud ausgeführt wird und zu diesem Zweck auf lokal gehostete LLMs setzt.

Case 1: Bilder lokal mit FLUX generieren

Die Suche nach einem Bild zur Verwendung auf der Arbeit, bei der Ausbildung, an der Universität oder in der Schule kann seit jeher eine Herausforderung sein: Welches Bild passt und darf es dann auch aus rechtlichen Gründen überhaupt verwendet werden?

Als Alternative ist für viele die Generierung eines Bildes per KI heute längst zum Standard geworden. Doch in der Cloud sind Freikontingente schnell verbraucht, die Wartezeiten oftmals hoch und der Prompt sowie das Resultat – je nach Tarif – sofort Teil der Trainingsdaten des Modells.

Bilder lassen sich aber auch lokal mittels KI per Texteingabe generieren und mit Nvidia Blackwell dank NVFP4-Support so schnell und speichereffizient wie nie zuvor.

Mehr Leistung durch FP4-Support

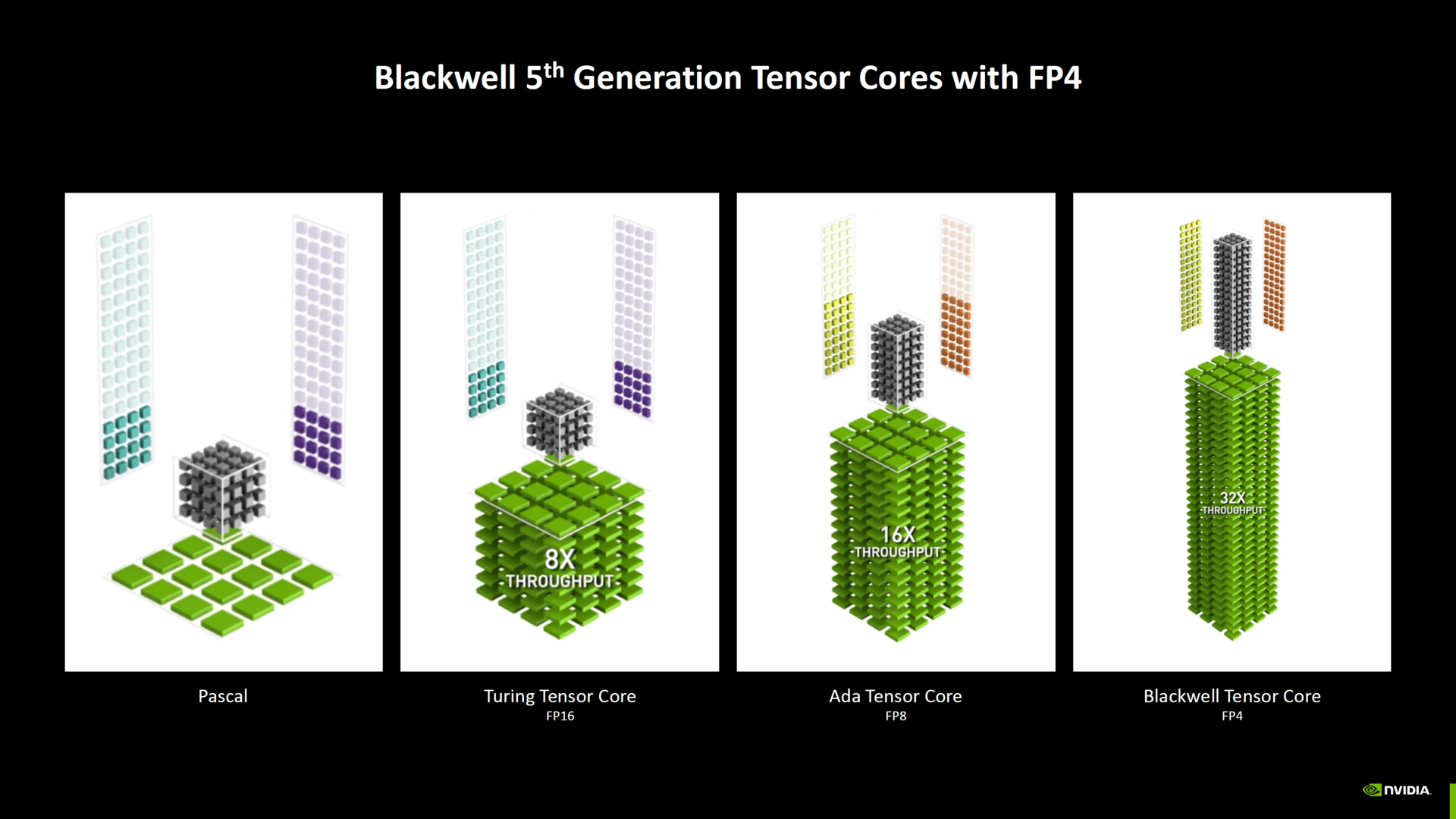

Mit Blackwell hat die 5. Generation Tensor-Kerne („KI-Kerne“) bei Nvidia Einzug gehalten. Sie können erstmals nativ mit dem Datenformat FP4 (NVFP4) umgehen, während Ada Lovelace für deren Berechnung noch FP8-Register belegen musste – das kostete Leistung, statt sie zu erhöhen.

Blackwell wiederum kann, wenn eine für KI-Tasks typische Matrizenberechnung mit FP4-Genauigkeit arbeitet, bei gleichem Takt mit der neuen Fähigkeit doppelt so viele Operationen durchführen wie Ada Lovelace mit FP8 – und dabei noch Platz im Grafikspeicher einsparen. Dank Nvidias TensorRT Model Optimizer halten sich Qualitätsabstriche durch den Verlust an Präzision im Endergebnis in Grenzen.

Nativer NVFP4-Support in FLUX.2

FLUX vom deutschen KI-Startup Flux AI war eines der ersten KI-Modelle zur Bilderzeugung, das NVFP4 nativ zu nutzen wusste. FLUX.2, das derzeit führende Modell zur Ausführung auf PCs, bietet den Support seit Anfang 2026 ebenfalls bereits für alle Modellvarianten (Dev, Klein 9b, Klein Base 9b, Klein 4b) an (Downloads auf Hugging Face).

Die wesentlichen Voraussetzungen

Durch die Nutzung der jeweiligen NVFP4-Variante können Blackwell-Inhaber nicht nur in der halben Zeit Bilder erstellen lassen, sondern auch mit weniger als der Hälfte VRAM auskommen.

Damit das klappt, ist lediglich darauf zu achten, dass auch ComfyUI und PyTorch aktuell genug sind, um Nvidia NVFP4 zu unterstützen. Dann steht der schnellen lokalen KI-Bildgenerierung auf einem Nvidia RTX AI-PC mit Nvidia Blackwell unter Windows oder Linux nichts mehr im Weg.

- ComfyUI mit NVFP4-Support („Benutzeroberfläche“), (mehr Details)

- PyTorch mit NVFP4-Support (Open-Source-Programmbibliothek, mindestens CUDA 13.0 (cu130))

- FLUX.2 mit NVFP4-Support (KI-Modell)

Im Nvidia Blog steht ein umfangreiches Tutorial zum Einrichten von FLUX.2 unter ComfyUI zur Verfügung:

Case 2: OpenClaw auf GeForce RTX 5000 nutzen

Ebenfalls sehr gut für die lokale Ausführung geeignet sind Large Language Models (LLMs), sei es separat über Plattformen wie LM Studio, oder als eine Komponente des extrem angesagten KI-Assistenten OpenClaw.

Das alles kann OpenClaw

OpenClaw ist ein experimentelles Open-Source-Projekt, das moderne Sprachmodelle nutzt, um auf PC oder Notebook selbstständig Aufgaben auszuführen, Entscheidungen zu treffen und mit digitalen Umgebungen zu interagieren, ähnlich einem autonomen Software-Assistenten. Zu den Fähigkeiten eines mit OpenClaw erstellten KI-Assistenten gehören:

- Dateien & Organisation: Er kann Dateien sortieren, umbenennen, verschieben, Backups anlegen oder Downloads automatisch strukturieren.

- Programme steuern: Er öffnet Anwendungen, führt einfache Abläufe aus (zum Beispiel Daten in Excel eintragen oder Programme konfigurieren) und kann wiederkehrende Klick- und Tastaturaufgaben automatisieren.

- Internet & Recherche: Er sucht Informationen, fasst Webseiten zusammen, lädt Inhalte herunter oder füllt Formulare automatisch aus.

- Kommunikation: Er kann E-Mails vorformulieren, beantworten oder sortieren sowie Nachrichten in Tools wie Slack vorbereiten.

- Systemaufgaben: Dazu gehören Updates prüfen, einfache Wartung (zum Beispiel temporäre Dateien löschen) oder Skripte ausführen.

- Individuelle Automatisierung: Etwa „Wenn ich eine Rechnung bekomme, speichere sie im richtigen Ordner und trage die Daten in eine Tabelle ein“.

Und das ist nur ein Ausschnitt an möglichen Assistenzfunktionen, die der KI-Assistent von OpenClaw über optionale Skills „erlernen“ kann. Weitere Beispiele liefern die OpenClaw Showcases.

Mit dem KI-Assistenten kommuniziert wird übrigens wie mit einer anderen Person: Per WhatsApp, Telegram, Discord, Slack, Signal oder iMessage – in Direktnachrichten oder Gruppenchats.

Gute Gründe für lokale LLMs

Deutlich wird: Viele Aufgaben umfassen persönliche Daten, die Nutzer häufig nicht in die Cloud geben wollen. Darüber hinaus ruft OpenClaw kontinuierlich verbundene Cloud-KI-Dienste auf, was auch in kostenpflichtigen Tarifen schnell die gesetzten Limits erreichen lässt. OpenClaw nur mit lokalen LLMs zu verknüpfen, bietet sich damit geradezu an. Und ist gar nicht schwer.

So lässt sich OpenClaw rein lokal einrichten

OpenClaw lässt sich auf jedem RTX AI-PC installieren und explizit für die Nutzung rein lokaler LLMs konfigurieren. Sowohl für die Konfiguration mit LM Studio als auch Ollama hat Nvidia ein umfassendes Tutorial erstellt. Auch was es beim Einsatz von OpenClaw zu bedenken gilt, wird dort ausführlich thematisiert:

Leistungsstarke RTX AI-PCs bei MIFCOM

RTX AI-PCs lassen sich mit einer Nvidia GeForce RTX 5000 und dazu passenden Komponenten selbst zusammenstellen, oder perfekt zusammengebaut, mit Software versorgt und getestet bei MIFCOM erwerben. Drei Jahre Garantie in der EU und drei Jahre Pick-Up & Return (DACH + FR) gibt es oben drauf. Und mit der MIFCOM A+ Installation einer zuverlässigen, sicheren und stets auf dem neuesten Stand verfügbaren Software-Installation (OS, BIOS, Treiber) ist der Computer direkt einsatzbereit, ohne dass man sich zuerst mit lästigen Einrichtungsproblemen herumschlagen muss. Was sonst noch für MIFCOM spricht? Hier gibt's alle Details.

Bei MIFCOM dreht sich alles um Leidenschaft, Innovation und erstklassige Qualität.

MIFCOM bietet Systeme für jeden Einsatzzweck, Geldbeutel und Geschmack – vom kleinen Einsteiger-Gamer bis zur Quad-GPU-Dual-CPU-Workstation wird alles geboten. Vier Beispiele für RTX AI-PCs:

Einstiegs-PC mit RTX 5060

Dieses System setzt auf einen AMD Ryzen 5 7500F und eine Nvidia GeForce RTX 5060. Die restliche Ausstattung ist passend dimensioniert. 16 GB DDR5 RAM bieten genug Reserven selbst für aufwendiges Multitasking. Die verbaute M.2-SSD sorgt für schnelle Lade- & Reaktionszeiten von Betriebssystem, Spielen & Anwendungen.

Mittelklasse-PC mit RTX 5070

Mit der GeForce RTX 5070 und dem Ryzen 7 9700X stehen im Mittelklasse-Rechner schnellere Komponenten zur Wahl. Auch Grafikspeicher und RAM (32 GB) fallen größer aus. Auch größere KI-Modelle können mit höherer Leistung ausgeführt werden.

High-End-PC mit RTX 5080

Die GeForce RTX 5080 und ein Ryzen 7 9850X3D stellen das Herz des High-End-PCs dar, das im Gehäuse von Corsair mit AIO auch optisch Blicke auf sich zieht. 32 GB RAM gibt es auch hier, Grafikspeicher (16 GB) und SSD (2 TB) wachsen abermals. Mit diesem Rechner sind auch fortschrittliche lokale AI-Anwendungen spielend möglich.

Im edlen Holz-Gewand

Ein echter Blickfang der anderen Art ist das in Holz gehüllte System mit GeForce RTX 5070 und Ryzen 7 9800X3D, das das Naturmaterial an der Front gekonnt in Szene setzt. 32 GB RAM und eine 2 TB große SSD gibt es auch in diesem Rechner.

Und nicht vergessen: Alle vier Systeme eignen sich natürlich dank GeForce RTX mit DLSS 4.5 auch perfekt für Gaming oder die Beschleunigung kreativer Apps.