@DevPandi:

Hat Computerbase.de ggfls noch bald vor, auch eine Warnung mit einem gezielten Test an Neukäufer von low end oder mid range GPUs 8 GB VRam Karten auszusprechen?

Bis auf alte E-Sport Titel, sollte das ggfls. schon längst überfällig sein, oder?

Habe mal ein paar Links gesammelt, da ich auch Kumpels habe, die immer wieder darauf reinfallen trotz meiner Warnungen, da sie ja nur 1080 p spielen aber sich dann später ärgern 🤬.

https://www.tomshardware.com/pc-com...-due-to-lack-of-vram-and-not-just-at-4k-ultra

https://www.pcgames.de/Hardware-The...Sparfuechse-Einsteigergrafikkarten-1479823/3/

https://videocardz.com/newz/nvidia-...16gb-model-in-gaming-performance-review-shows

Selbst da würden alte GPUs interessant sein und mehrere Vergleiche rein nach VRam Vergleich und gezielten 3 Spielen (niedrige Anforderungen, mittlere Anforderungen, hohe Anforderungen) inkl. Upscaling an / aus, mit drei bis max. vier Standard Presets.

Müssen ja nicht viele Spiele sein.

Hauptsache diese favorisieren keinen GPU Hersteller (wegen Engine Optimierungen oder weil starke Ausreißer vorhandenen sind) .

(und bitte auch sowas wie GTX 1060, RTX 2060, RTX 3060, RTX 4060, RTX 5060, RTX 5060 TI 8 GB VRam vs 16 GB VRam , AMD RX 9060 XT 8 GB vs 16 GB VRam, VRam, je nach Generation etc. alle nach VRam und Leistung gestaffelt in den 1% FPS lows ^^ für Low End und Mid Range GPUs).

Dann kann hätte man auch wirklich eine Auskunft über:

- VRam vs VRam je nach Serie

- Effizienz nach Serie (Speicher 8 GB , 10 GB , 12 GB , 16 GB werden unter einander sauber verglichen)

- Leistung untereinander nach VRam und 1 % FPS low

- Effizienz nach Frame Limit 60 Hz,120 Hz , 144 Hz, unlimited

Und ganz wichtig. Preise bleiben dynamisch und werden von dem Hersteller vorgegeben, nach Händler und nach aktueller Knappheit.

Das sollte gar nicht zählen, da es immer nur eine kurze Momentaufnahme darstellt.

Es sollte doch nur zählen, in welche Hersteller Kategorie wurden diese einsortiert (Low End, Mid Range). 😁

Dann entscheiden die Käufer doch selbst nach Preis und Leistung, ob die Karten wie Blei in den Regalen liegen bleiben oder man ggfls. Als reiner E-Sportler Game Zocker nur dann 50 € bis 100 € weniger die 8 GB VRam Variante oder ältere Karten gebraucht erwirbt. Oder?

Was aber unveränderlich bleibt ist der vorhandene VRam, die Leistung, Leistungsaufnahme bzw. Effizienz, Bottlenecks.

Könnte ja ggfls. auch was für

@Wolfgang sein (sorry! ^^).

Ansonsten findet man so gut wie keine Legacy Benchmarks.

Dies ist eine der selten Quellen, das interessiert doch in der Regel wirklich jeden potentiellen Aufrüster, welcher nach 4 - 8 Jahren sich eine neue GPU gönnen möchte.

https://en.gamegpu.com/test-gpu/act...egacy-test-gpu-cpu?highlight=WyJsZWdhY3kiXQ==

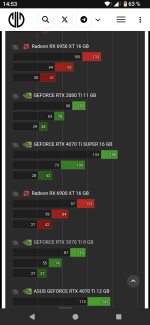

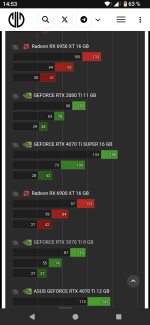

Da kommt dann plötzlich so was raus bei nur Leistungsvergleich unter GPU Generationen!

Wie kann das sein und warum interessiert das euch (Community und Redaktion) ggfls. bisher nicht?!

Wie kann es sein, dass nach so vielen Jahren eine RTX 2080 TI (Release date 2018) fast eine RTX 4070 TI Super schlagen kann (Release date 2024), eine RTX 4070 TI (Release date 2023) und AMD RX 6900 XT (Release date 2020) fast deklassiert wird und es juckt niemanden?! 🫢 😉

Das ist doch blanker Hohn. 😁 😂

Schade das keine GTX 1080 TI dabei ist, dass wäre bestimmt auch schmerzhaft. 😁

Normalerweise sollte die EU einen dauerhaften Treiber Support für alte GPUs festlegen. Dann könnten, CPU, GPU Hersteller und Software Anbieter nichts mehr verschleiern und upselling betreiben.

Schönen sonnigen Tag euch allen! 🤛