Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

News Sapphire × Ryzen AI Max+ 395: Zusammenschaltbare Mini-PCs mit Strix Halo für riesige LLMs

tomgit

Rear Admiral

- Registriert

- Nov. 2015

- Beiträge

- 5.329

Ändert wenig dran, dass der Support durch AMD ein Trauerspiel ist. Die Fragmentierung des Supports für ROCm ist abstrus:ETI1120 schrieb:Wie alt ist das Video?

- Unter Windows läuft das meiste - wenn es läuft. Ich habe ein Zbook Ultra G1a, da wird von Seiten HP im Adrenalin Treiber (egal ob Pro oder "Normal") sehr viel gesperrt, selbst nach DDU-Deinstall und "sauberem" Install bekommt man Variable Memory nicht zu laufen. Dafür hat es dort den "besten" Support für GAIA und andere AMD-eigene Frameworks. Was halt nicht viel bringt, wenn man die Größe des VRAMs im BIOS einstellen darf.

- Unter Linux läuft es am "Besten" unter Ubuntu, aber auch dort nicht ohne Gefrickel. Variable Memory muss per Config-Datei oder als GRUB-Parameter eingestellt werden. Darauf zu stoßen ist nicht sonderlich intuitiv. Und selbst unter der am besten supporteten Linux-Distro läuft manches einfach gar nicht, GAIA hat dort einen reduzierten Funktionsumfang und Zugriff auf die NPU ist ein Glücksspiel

- Unter Fedora/Arch/etc. darf man hoffen, dass es freiwillige Community-Maintainer gibt, weil dort ist der Support von Seiten AMDs nicht schlechter. Offiziellen Support für Fedora gibt es wohl gar nicht oder maximal eingeschränkt, in Github findet man sogar von AMD die Aufforderung, dass man als Contributer für den Support von Fedora mitwirken sollte, da es keine "short term plans" für offizielle Unterstützung gibt: https://github.com/amd/gaia/issues/108

Dafür, dass AMD in den letzten Jahren so massiven Umsatz macht und es, mit Microsoft zusammen, als "AI Workstation" anbietet, ist der Zustand des Supports auch fast ein Jahr nach der Veröffentlichung lächerlich. Und inzwischen will man über 5k für das Gerät - da ist man wirklich besser bedient, wenn man zu Apple greift.

Und daneben gibt es noch weitere Probleme:

Kein Kernel-level Support für die Webcam des Zbooks ohne Anpassungen, da es auf AMDs neuen ISP zurückgreift, einzige Ausnahme scheint CachyOS zu sein, welches mit gepatchtem Kernel ausgeliefert wird; Die Installation von Windows erfordert LAN-Verbindung, da der Treiber der WLAN-Karte noch nicht im Image von Windows 11 drin ist; und das glossy Display ist schlicht zu dunkel für die reflektierende Oberfläche.

Ein LLM besteht intern aus vielen aufeinander gestapelten Schichten (Layers). Ein 70B-Modell in Q4-Quantisierung hat z.B. 80 solcher Schichten und braucht ca. 40 GB Speicher. Wenn das nicht in eine einzelne GPU passt, muss das Modell irgendwie aufgeteilt werden. Dafür gibt es zwei grundlegend verschiedene Ansätze.

Pipeline Parallelism (Layer-Split) die übliche Consumer Methode "Ollama"

Das Modell wird schichtweise aufgeteilt: GPU 1 bekommt z.B. Layer 0–39, GPU 2 bekommt Layer 40–79. Bei der Token-Generierung geht der Input zuerst in GPU 1, wird dort durch die ersten Schichten verarbeitet, dann wird das Zwischenergebnis (ein relativ kleiner Tensor, nicht das ganze Modell) über die Verbindung an GPU 2 geschickt. GPU 2 rechnet die restlichen Schichten, und am Ende fällt der nächste Token raus.

Wichtig: Es wird dabei nicht parallel gerechnet. Es ist wie ein Fliessband — GPU 1 arbeitet, dann wartet sie, während GPU 2 arbeitet, dann wartet GPU 2 wieder. Je mehr GPUs beteiligt sind, desto mehr Übergaben gibt es, und jede Übergabe kostet Zeit. Bei zwei GPUs im selben System läuft das über den PCIe-Bus (ca. 32 GB/s bei PCIe 5.0 x16), was gegenüber dem internen Speicherzugriff einer GPU (z.B. ~1.000 GB/s bei einer RTX Pro 5000 Blackwell) ein Flaschenhals ist, aber bei Inferenz noch akzeptabel, weil pro Schritt nur ein kleiner Tensor übertragen wird, nicht das gesamte Modell.

Tensor Parallelism, vLLM und Datacenter-Setups "NVIDIA DGX"

Das ist die Methode, die vLLM und Datacenter-Setups (z.B. NVIDIA DGX) nutzen. Bei der Tensor Parallelism Methode wird nicht Layer für Layer aufgeteilt, sondern innerhalb jedes Layers werden die Gewichtsmatrizen in Scheiben geschnitten. Jede GPU rechnet einen Teil jedes Layers gleichzeitig, und die Teilergebnisse werden dann zusammengeführt. Das ermöglicht echte Parallelität — aber es erfordert extrem schnelle Verbindungen zwischen den GPUs, weil bei jedem einzelnen Layer synchronisiert werden muss. In Datacentern gibt es dafür NVLink (bis 900 GB/s) oder InfiniBand. Über normales PCIe oder gar Ethernet ist echter Tensor Parallelism ein massiver Flaschenhals, weil die Kommunikation pro Token um Grössenordnungen häufiger stattfindet als bei Pipeline Parallelism.

Pipeline Parallelism (Layer-Split) die übliche Consumer Methode "Ollama"

Das Modell wird schichtweise aufgeteilt: GPU 1 bekommt z.B. Layer 0–39, GPU 2 bekommt Layer 40–79. Bei der Token-Generierung geht der Input zuerst in GPU 1, wird dort durch die ersten Schichten verarbeitet, dann wird das Zwischenergebnis (ein relativ kleiner Tensor, nicht das ganze Modell) über die Verbindung an GPU 2 geschickt. GPU 2 rechnet die restlichen Schichten, und am Ende fällt der nächste Token raus.

Wichtig: Es wird dabei nicht parallel gerechnet. Es ist wie ein Fliessband — GPU 1 arbeitet, dann wartet sie, während GPU 2 arbeitet, dann wartet GPU 2 wieder. Je mehr GPUs beteiligt sind, desto mehr Übergaben gibt es, und jede Übergabe kostet Zeit. Bei zwei GPUs im selben System läuft das über den PCIe-Bus (ca. 32 GB/s bei PCIe 5.0 x16), was gegenüber dem internen Speicherzugriff einer GPU (z.B. ~1.000 GB/s bei einer RTX Pro 5000 Blackwell) ein Flaschenhals ist, aber bei Inferenz noch akzeptabel, weil pro Schritt nur ein kleiner Tensor übertragen wird, nicht das gesamte Modell.

Tensor Parallelism, vLLM und Datacenter-Setups "NVIDIA DGX"

Das ist die Methode, die vLLM und Datacenter-Setups (z.B. NVIDIA DGX) nutzen. Bei der Tensor Parallelism Methode wird nicht Layer für Layer aufgeteilt, sondern innerhalb jedes Layers werden die Gewichtsmatrizen in Scheiben geschnitten. Jede GPU rechnet einen Teil jedes Layers gleichzeitig, und die Teilergebnisse werden dann zusammengeführt. Das ermöglicht echte Parallelität — aber es erfordert extrem schnelle Verbindungen zwischen den GPUs, weil bei jedem einzelnen Layer synchronisiert werden muss. In Datacentern gibt es dafür NVLink (bis 900 GB/s) oder InfiniBand. Über normales PCIe oder gar Ethernet ist echter Tensor Parallelism ein massiver Flaschenhals, weil die Kommunikation pro Token um Grössenordnungen häufiger stattfindet als bei Pipeline Parallelism.

Epistolarius

Lieutenant Pro

- Registriert

- Nov. 2012

- Beiträge

- 605

Hm, sorry, aber wo ist die News genau? Mini-PCs mit Strix Halo zusammenzuschalten ist ja nichts neues, wie bspw. bei Framework:

https://www.computerbase.de/news/pc...91559/#abschnitt_framework_desktop_im_verbund

https://www.computerbase.de/news/pc...91559/#abschnitt_framework_desktop_im_verbund

- Registriert

- Jan. 2007

- Beiträge

- 2.701

Ach 10 Gbit/s ob mit USB-C oder per LAN taugen doch nichts. Ausser einer Machbarkeitsstudie bleibt da nicht viel übrig. Wird Zeit das uns KI endlich auch mal was positives im Hardwarebereich beschert und man mal deutlich schnellere Schnittstellen anbietet. Aber den Aufwand da dual LAN für LLM Inferenz einzubauen können sie sich schenken. Eine zweite USB-C Buchse schadet nicht, aber solange da nicht USB 4.0 mit 40 oder gar 80Gbits drüber huschen ist das vergebene Mühe.

eastcoast_pete

Commander

- Registriert

- Juni 2020

- Beiträge

- 2.497

+1! Der schnelle Netzwerk Anschluss "ab Werk" ist ein wichtiger (zentraler) Teil der "Value Proposition" der DGX. Der DGX hilft natürlich auch, daß Nvidia seit einigen Jahren Mellanox besitzt, und Nvidia Milliarden in schnelle und sehr schnelle Netzwerk Technologie investiert hat. Sieht man schnell, wenn man nach einer 100 Gbit/s Adapter Karte zum selbst nachrüsten sucht, denn die fangen bei ~ € 400 an, und kosten schnell das Doppelte.Rickmer schrieb:Wenn die besseres Netzwerk einbauen wollen für die Verbindung - werden die dann mit dem DGX Spark und dessen 100 Gbit gleich ziehen?

Bei der Sapphire Strix Halo für KI wär noch interessant, wenn Sapphire bei der ein PCIE Dock implementieren könnte (wie es zB Beelink für ein paar ihrer mini-PCs gemacht hat*) . So könnte man dann eine Radeon 9700 XT oder auch Pro anschließen, wenn's primär um höhere Rechenleistung geht.

@stefan92x : Damit hätte Sapphire dann für Strix Halo wirklich etwas richtig neues. Aber da müssten sie sich schon rein knien; würde sich IMHO aber lohnen.

* Aus (mir) unbekannten Gründen gibt's diese Docks bislang nur mit mini-PCs auf Intel-Basis. Haben die AMD APUs nicht genug PCIE Bahnen dafür?

Zuletzt bearbeitet:

Scheint mir auch bisschen spät so "AI ich bin (auch noch) dabei". Die Zusammenschalterei ist doch ein Gimmik. Das kann man mit dem Framework auch. Da gibt es ja genug Videos zu - und die Grenzen davon sind hier ja schon genannt worden.

Am Ende eine Frage des Preises.

Strix Halo war bisher nicht gerade günstig, ist jetzt eigentlich schon veraltet, hätte durch Konkurrenz durch Panther Lake vielleicht preislich unter Druck geraten können, nur das scheint ja auszublieben. Panther Lake Geräte sind bisher alle absurd teuer.

Das spannenste bzgl. Strix Halo dürften nicht weitere AI-Boxen sein, sondern endlich Notebooks und die neuen Ableger mit abgespeckter CPU und vollem GPU-Ausbau. Aber am Ende ist es schon die Resteverwertung einer veralteten Plattform. RDNA 3(.5) for ever lässt grüßen.

Und da kommt es dann um so mehr auf den Preis an. Und da erwarte ich keine positiven Überraschungen mehr angesichts der Allerweltsentschuldigung Speicherpreise.

Am Ende eine Frage des Preises.

Strix Halo war bisher nicht gerade günstig, ist jetzt eigentlich schon veraltet, hätte durch Konkurrenz durch Panther Lake vielleicht preislich unter Druck geraten können, nur das scheint ja auszublieben. Panther Lake Geräte sind bisher alle absurd teuer.

Das spannenste bzgl. Strix Halo dürften nicht weitere AI-Boxen sein, sondern endlich Notebooks und die neuen Ableger mit abgespeckter CPU und vollem GPU-Ausbau. Aber am Ende ist es schon die Resteverwertung einer veralteten Plattform. RDNA 3(.5) for ever lässt grüßen.

Und da kommt es dann um so mehr auf den Preis an. Und da erwarte ich keine positiven Überraschungen mehr angesichts der Allerweltsentschuldigung Speicherpreise.

crustenscharbap

Rear Admiral

- Registriert

- Jan. 2008

- Beiträge

- 5.496

Gibts den auch mit Ryzen AI 385? Finde den bald spannender. iGPU ist so flott wie bei Panther Lake und der Chip ist halt deutlich billiger.

Für KI Sachen, die ich mache, langt der auch und bei 32GB RAM sind halt 24GB nutzbar für ne KI.

Aber ich finde den halt spannend, da unter 1000€ und halt in Grafik doch etwas schneller als ein 370, was bei Spielen oder Videoschnitt schon nice ist.

Für KI Sachen, die ich mache, langt der auch und bei 32GB RAM sind halt 24GB nutzbar für ne KI.

Aber ich finde den halt spannend, da unter 1000€ und halt in Grafik doch etwas schneller als ein 370, was bei Spielen oder Videoschnitt schon nice ist.

Darum geht es nicht.tomgit schrieb:Ändert wenig dran, dass der Support durch AMD ein Trauerspiel ist.

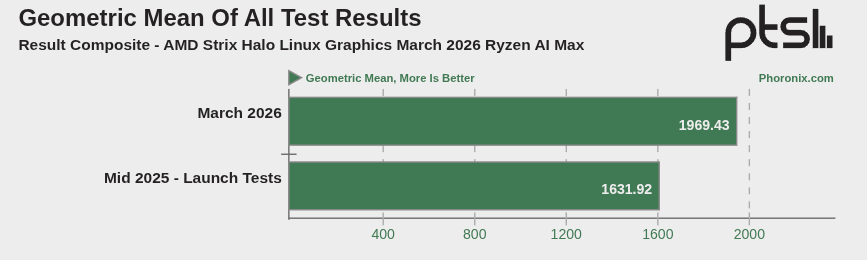

Endlich ist in die schläfrige Entwicklung bei ROCm Fahrt reingekommen. Es ist zwar noch nicht gut. Aber es ist erheblich besser als vor einem halben Jahr.

Ich denke hier kann man sehen, dass sich etwas getan hat:

https://www.phoronix.com/review/ubuntu-2604-strix-halo/4

https://www.phoronix.com/review/ubuntu-2604-strix-halo/4

Ähnliche Themen

- Antworten

- 133

- Aufrufe

- 13.677

- Antworten

- 7

- Aufrufe

- 1.142

- Antworten

- 26

- Aufrufe

- 3.691

- Antworten

- 35

- Aufrufe

- 4.107

- Antworten

- 278

- Aufrufe

- 29.545