GrandTheft

Lt. Commander

- Registriert

- Dez. 2008

- Beiträge

- 1.278

Hallo zusammen,

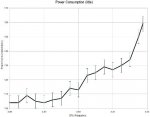

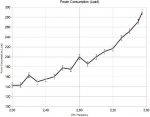

ich habe mal den Stromverbrauch beim Overclocking eines Q6600 gemessen, insb. auch das Underclocking. Die Ergebnisse will ich euch nicht vorenthalten.

Dazu habe ich bei folgendem System

Intel Quad Core Q6600

Gigabyte GA-P35-DS3

Silverstone ST-50EF

XFX GTX260 XT

8GB DDR2-800 Mushkin

Mit einem festen Multi von 9 und eingeschalteten Stromsparfunktionen des Prozessors (!) jeweils die angegebene Taktfrequenz eingestellt, den minimal stabilen VCore eingestellt und ca. 1 Stunde auf Stabilität getestet (für den Alltag zu wenig, für diese Messung genug).

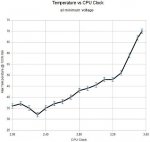

Dann habe ich die Temperatur bei maximaler Kühlung (Lüfter auf 100%), den Stromverbrauch im idle und unter Last primärseitig gemessen und aufgezeichnet. Die Grafikkarte lief dabei immer im 2D-Modus, in dem sie lt. NVidia ja um die 25 Watt verbrauchen soll.

Man sieht, dass das Underclocking eigentlich fast nichts bringt, so lange man beim Standardtakt den VCore ggf. etwas reduziert. Außerdem führt extremes Übertakten zu stark erhöhtem Stromverbrauch und natürlich auch zu höheren Temperaturen.

Zu beachten ist, dass der Stromverbrauch primärseitig gemessen wurde, d.h. die Aufnahme der Systemkomponenten ohne Netzteil müsste noch mit der Effizienz von ca. 80% multipliziert werden, ändert sich natürlich aber über den gemessenen Bereich, weshalb ich es weggelassen habe.

Die Leistungsaufnahme der Grafikkarte geht fast im Rahmen der Fehler unter, man muss also für den Verbrauch unter CPU- UND Grafik-Last noch mit ~ 0.8 multiplizieren (Netzteileffizienz) UND die maximale Leistungsaufnahme der Grafikkarte minus 25W draufaddieren.

Bei den Temperaturen ist von einer Änderung der Raumtemperatur von bis zu 5°C über die Messung auszugehen (d.h. der echte Fehler ist größer, die Tendenz aber erhalten).

Gruß

GT

ich habe mal den Stromverbrauch beim Overclocking eines Q6600 gemessen, insb. auch das Underclocking. Die Ergebnisse will ich euch nicht vorenthalten.

Dazu habe ich bei folgendem System

Intel Quad Core Q6600

Gigabyte GA-P35-DS3

Silverstone ST-50EF

XFX GTX260 XT

8GB DDR2-800 Mushkin

Mit einem festen Multi von 9 und eingeschalteten Stromsparfunktionen des Prozessors (!) jeweils die angegebene Taktfrequenz eingestellt, den minimal stabilen VCore eingestellt und ca. 1 Stunde auf Stabilität getestet (für den Alltag zu wenig, für diese Messung genug).

Dann habe ich die Temperatur bei maximaler Kühlung (Lüfter auf 100%), den Stromverbrauch im idle und unter Last primärseitig gemessen und aufgezeichnet. Die Grafikkarte lief dabei immer im 2D-Modus, in dem sie lt. NVidia ja um die 25 Watt verbrauchen soll.

Man sieht, dass das Underclocking eigentlich fast nichts bringt, so lange man beim Standardtakt den VCore ggf. etwas reduziert. Außerdem führt extremes Übertakten zu stark erhöhtem Stromverbrauch und natürlich auch zu höheren Temperaturen.

Zu beachten ist, dass der Stromverbrauch primärseitig gemessen wurde, d.h. die Aufnahme der Systemkomponenten ohne Netzteil müsste noch mit der Effizienz von ca. 80% multipliziert werden, ändert sich natürlich aber über den gemessenen Bereich, weshalb ich es weggelassen habe.

Die Leistungsaufnahme der Grafikkarte geht fast im Rahmen der Fehler unter, man muss also für den Verbrauch unter CPU- UND Grafik-Last noch mit ~ 0.8 multiplizieren (Netzteileffizienz) UND die maximale Leistungsaufnahme der Grafikkarte minus 25W draufaddieren.

Bei den Temperaturen ist von einer Änderung der Raumtemperatur von bis zu 5°C über die Messung auszugehen (d.h. der echte Fehler ist größer, die Tendenz aber erhalten).

Gruß

GT

Anhänge

Zuletzt bearbeitet: