Alles nicht ganz einfach. Es gibt schon einige Ansätze, die ein Voranschreiten bedeuten könnten. Ob es dann auch funktioniert oder wir bald auf Grenzen stoßen, insbesondere wenn es nicht um Parallelität geht. Quantencomputer stecken noch in den Kinderschuhen und ob die die Aufgaben von klassischen Computern komplett abdecken können, bleibt auch offen, sieht ja auch eher nach massiv paralleler Rechenkraft aus.

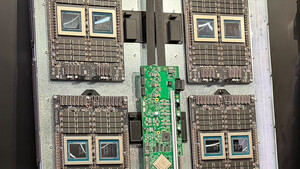

Auf Basis des Klassikers Silizium wird es wohl nicht lange so weiter gehen. Ich glaube, es war Gallium, auf dessen Basis es ein Schritt weiter gehen kann, was Miniaturisierung angeht. Graphen muss man überhaupt erst einmal in den Griff bekommen, lässt sich damit ein Chip wirklich herstellen und kann man dann damit zuverlässig arbeitende Logiken mit realisieren? Computer auf Neuronenbasis? Können die eigentlich auch mehr als nur Parallel? Unser Gehirn verarbeitet ja eine menge Daten, ohne das es uns bewusst ist, vieles davon dürfte auch eher auf massiv Parallel hinauslaufen, Reize aus Millionen "Sensoren" werden analysiert, unrelevante Teile rausgefiltert und dann zu ein Ganzes zusammengefügt, klingt auch alles nach Parallel.

Sicher, viele Probleme lassen sich bestens Parallel lösen, aber eben auch nicht alle, und genau da könnte als erstes die Hürde entstehen. Also könnte die sukzessive Verarbeitung bald stagnieren, während es bei der simultanen Verarbeitung noch viel länger weiter geht.

Es bleibt die Frage: Geht es immer weiter, nur weil es bisher so war?

Steckt im Universum doch mehr Plan dahinter (ohne jetzt an eine übergeordnete, omnipräsente Macht/Kreatur zu denken)?

Immerhin ist es schon jetzt erstaunlich, wo wir bereits technologisch hingekommen sind, bei den doch sehr beliebig anmutenden Stoffen, die wir zur Verfügung haben. Genauso erstaunlich, wie dass wir überhaupt existieren. Nur mal als Denkansatz.

Auf Basis des Klassikers Silizium wird es wohl nicht lange so weiter gehen. Ich glaube, es war Gallium, auf dessen Basis es ein Schritt weiter gehen kann, was Miniaturisierung angeht. Graphen muss man überhaupt erst einmal in den Griff bekommen, lässt sich damit ein Chip wirklich herstellen und kann man dann damit zuverlässig arbeitende Logiken mit realisieren? Computer auf Neuronenbasis? Können die eigentlich auch mehr als nur Parallel? Unser Gehirn verarbeitet ja eine menge Daten, ohne das es uns bewusst ist, vieles davon dürfte auch eher auf massiv Parallel hinauslaufen, Reize aus Millionen "Sensoren" werden analysiert, unrelevante Teile rausgefiltert und dann zu ein Ganzes zusammengefügt, klingt auch alles nach Parallel.

Sicher, viele Probleme lassen sich bestens Parallel lösen, aber eben auch nicht alle, und genau da könnte als erstes die Hürde entstehen. Also könnte die sukzessive Verarbeitung bald stagnieren, während es bei der simultanen Verarbeitung noch viel länger weiter geht.

Es bleibt die Frage: Geht es immer weiter, nur weil es bisher so war?

Steckt im Universum doch mehr Plan dahinter (ohne jetzt an eine übergeordnete, omnipräsente Macht/Kreatur zu denken)?

Immerhin ist es schon jetzt erstaunlich, wo wir bereits technologisch hingekommen sind, bei den doch sehr beliebig anmutenden Stoffen, die wir zur Verfügung haben. Genauso erstaunlich, wie dass wir überhaupt existieren. Nur mal als Denkansatz.