@KCX

amd schrammt ganz knapp an dem vorbei, was man versprochen hat. hier kann man ein auge zudrücken, weil die cpus an sich wirklich beeindruckend sind. aber wenn man das mal ganz nüchtern betrachtet, finde ich hier kritik trotzdem berechtigt. man schlängelt sich hier schon eher durch und abseits vom übertriebenen max boost ist man doch sehr zurückhaltend.

1. der angegebene 4,6 ghz boost wird von fast keinem 3900X erreicht. man sieht hier auch spannungen, die weit über 1,45v hinausgehen. ich werde das gefühl nicht los, dass man hier "überambitioniert" an die sache rangegangen ist.

entweder hat man sich auf 4,6 ghz festgelegt, weil das im marketing besser kommt, und man haut jetzt extreme spannungen auf die cpu um den takt irgendwie zu schaffen und es reicht teilweise trotz 1,5V nicht oder man hat die cpus mit besseren chips validiert und kommt jetzt wegen der niedrigen siliziumqualität aus der retailversion nicht mehr an den takt ran. es gibt keine langzeiterfahrung mit 7nm und diesen hohen spannungen.

beides ist nicht sonderlich erfreulich. die wahrheit liegt vermutlich irgendwo in der mitte.

dazu noch das hier:

robert hallock malt hier ganz unverfroren 4,75 ghz als PBO takt auf die tafel. das ist irreführung. keine ryzen cpu kommt ohne flüssigstickstoff auf diesen takt.

2. der preis. gegen intel steht amd ganz klar als die bessere wahl da - aber:

der IO die für den chipsatz kostet boardhersteller im EK $30-40, d.h. amd kostet das ding noch weniger. dazu kommen zwei chiplets, die gerüchteweise etwa bei $60-80 liegen. oder eher noch weniger. und dann kommt noch dazu, dass ryzen die schlechten chiplets bekommt, die generell schon einmal weniger wert sind. die chiplets, die in epyc zum einsatz kommen, werden quasi vergolded, wenn man sich hier mal den mm² preis anschaut. soweit keine beanstandung - das ist erstmal nur daten sammeln.

ein 3900X kostet amd grob geschätzt also $150 bis $220 und die wollen $500 dafür haben. ja, gegen intel ist man das bessere angebot, ABER bei der marge (

die sich amd durchaus verdient hat) will ich bei einer 530€ cpu zwei gute chiplets und nicht ein gutes und eines von der resterampe. beim 3950X verschärft sich das problem noch zusätzlich, denn der ist genau das selbe wie der 3900X, nur ohne deaktivierte kerne und 220€ aufpreis.

aus der sicht von amd absolut nachvollziehbar und eigentlich grandios gelöst. aber hier kann man ruhig auch mal den standpunkt eines verbrauchers vertreten, der das hinterher kauft und benutzt. wenn ich einen sack marmorkiesel kaufe, will ich nicht 50% dreck drin haben. "aber der steinbruch muss doch den dreck auch wegbekommen", aber genau für das gibts säcke mit dreck drin, wo auch "dreck" drauf steht.

die situation mit den boards und den uefi updates ist auch eine tragödie. man hatte doch jetzt genug zeit, um das ganze vorzubereiten. bei zen1 war das ganze ja noch absolut nachvollziehbar. aber wieso läuft hier bei release nix anständig? zen2 silizium gibts schon seit letztem jahr. wie kann man zum release am 07.07.19 immer noch unfertige uefis auf den neuen boards ausliefern? von den alten boards und dem kopfwehthema "msi" mal ganz zu schweigen. und hier häufen sich die aussagen, dass das hauptsächlich an AMD hängt, die viel zu spät samples an die boardhersteller rausgegeben haben (vermutlich um leaks zu vermeiden) und das durcheinander mit der blackbox AGESA.

wer hier ein "schönes" board haben will, bspw mit postcode, spielt roulette mit mindestens 300€ einsatz. bisher weiß ja noch niemand, wie gut die boards wirklich sind, weil durch die bank noch beta status vorherrscht. und gerade bei gigabyte kann man sich nicht wirklich drauf verlassen, dass das zukünftig besser wird - gigabyte arbeitet hier erfahrungsgemäß ja eher in die andere richtung. und bei der durchweg vermeintlich guten qualität der boards ab 300€ hängt halt

alles an der qualität vom uefi.

amd macht hier selbstbewusst auf dicke hose aber für die aufgerufenen preise für cpu und mainboards sind mir das ein paar ungereimtheiten an relativ schmerzhaften stellen zu viel. kaum hat man im cpu geschäft fuß gefasst, fängt das melken an - und am meisten trifft es genau die, die amd überhaupt erst in diese situation gebracht haben. die enthusiasten, die bei zen1 eiskalt bei release gekauft und sich durch die sehr steinigen ersten 6 monate gebissen haben.

ich will hier gewiss nichts schlecht reden; der 3600 ist für den preis in absolut jeder beziehung eine top cpu - aber der fisch stinkt ja bekanntlich vom kopf her. der 3700X ist noch gut, aber der 3800X ist reine chipletverschwendung. die hätte man auch gut in 3900X investieren können.

"we love XY" ist der lieblingssatz von lisa - wer sowas sagt, kann für die hardware-spinner, die ganz klar die zielgruppe für so eine extreme cpu (12/16 kerner) sind, auch zwei gute chiplets verlöten und den binning ausschuss irgendwo anders unterbringen, als gerade in diesen cpus.

bei all den kernen und pcie 4.0 darf man nicht vergessen, dass das hier immernoch mainstream ist. die threadripper boards, mit quad channel ram und 64 pcie lanes, kosten weniger. der 2920X kostet derzeit fast 200€ weniger als der 3900X und war zu release nur 100€ teurer. da stimmt irgendwie das verhältnis nicht.

parallel bei den GPUs passiert das selbe in grün (literally hihihi).

die 5700XT ist an sich eine hervorragende gpu - aber die ist für jeden, der nicht nur benchmark balken anschaut und den vergleich zu den überteuerten nvidia karten anstellt, offensichtlich ebenfalls zu teuer - aus konsumentensicht.

polaris 10 ist 232mm² mit 36CU und kostet mit 8gb $240 mrsp.

navi ist 250mm² mit 40 CU und kostet mit 8gb $400/450/500 mrsp. (5700 XT nach der anpassung, vor der anpassung, "geburtstagsedition" vor der anpassung). wer hier jetzt wen getrollt hat, ist mal sekundär. der kern ist die preiserhöhung um 100% verglichen mit polaris - das muss man sich erst einmal trauen. die 5700 hätte auch um die $270-290 kosten können und die 5700 XT $320-340. das wären faire preise gewesen, imo.

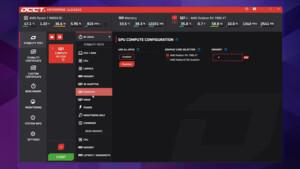

und dann wird die 5700 noch künstlich im oc headroom kastriert. hier hat sich amd von nvidia eine scheibe zu viel abgeschnitten.

das soll jetzt niemanden vom kauf von amd produkten abhalten - die sind in jedem fall noch gesünder für den eigenen geldbeutel und den markt insgesamt als die konkurrenz. das gibt amd aber keine immunität gegenüber kritik.

und noch eine gute nachricht für die 3900X käufer - ich habe von einem großen deutschen retailer auch gehört, dass am 26.07 eine große lieferung kommt und die soll möglicherweise sogar ausreichend groß sein, um von da an sämtliche nachfrage "ab lager" bedienen zu können.