dass die vermeintliche 2d-Wasseroberflaeche in meinen Augen besser aussah als die 3d

ditto.

Nicht alles was 3D ist, sieht auch gut aus. Manchmal ist eine gute Atrappe schöner als so manches 3D Objekt.

Der Vorteil liegt im geringeren Programmieraufwand für eine natürliche Aus/Beleutung.

Man gibt nur an was eine Lichtquelle ist, und wie durchlässig und reflektiertend die Texturen sind. Der Rest wird dann berechnet.

Klingt für Entwickler natürlich traumhaft.

Aber in Crysis sieht die Ausleuchtung auch sehr schön und natürlich aus. Zwar schwerer zu verwirklichen, dafür ist die Leistung auch noch um einiges schneller.

Und wie Herr Pohl selbst schreibt, braucht man für Soft-Schatten viel mehr Strahlen, das natürlich nochmals auf die Performance niederschlägt.

Kopi80 schrieb:

Am besten du beliest dich vllt. gleich mal mit den verlinkten anderen Artikeln zum Thema

Die anderen Artikel hatte ich damals durchgelesen. Und alles klang (erwartungsgemäß) gut und schön.

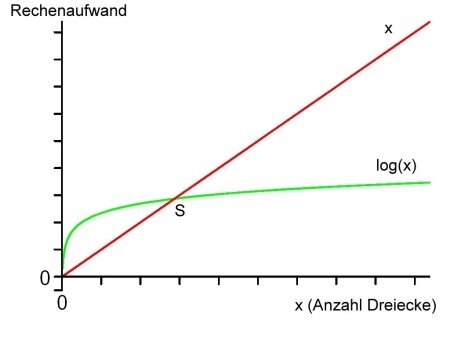

Jedoch zeigt die Grafik schon meinen Einwand: Sehr schematisch.

Genau der Schnittpunkt ist doch interessant. Ab wieviel Dreiecken "lohnt" sich Raytracing im Blick auf die Leistung? Ab 2000, 2Millionen oder gar 2 Milliarden?

Ist das immer so, oder nur wenn es optimal läuft?

Man kann natürlich imemr irgendwelche hypotetische Bedingungen aufstellen und entsprechende Grafikskalen justieren um Thesen zu beweisen.

Herr Pohl hat sicherlich mehr auf den Kasten als wir, dennoch bezweifle ich die uneingeschränkte Objektivität.

Er spielt eine entscheidende Rolle bei Intel - einem Unternehmen welches keine richtigen Raster-GPUs im Sortiment hat und gerade einen Raytracing-GPU entwickelt.

Und außerdem ist Raytracing sein Spezialgebiet.

Deshalb wird er es immer so hingestellen, als ob es die Lösung für Grafikprobleme wäre, selbst an Stellen wenn die gute alte Rasterierung sinnvoller wäre.