NSA überwacht 75 Prozent des Traffics in den USA

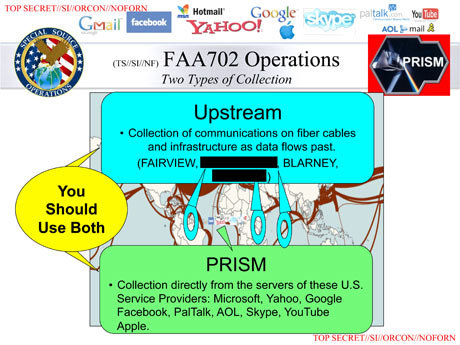

Die NSA hat Zugriff auf 75 Prozent des Internet-Traffic, der durch die USA fließt, berichtet das Wall Street Journal. An die Datenströme gelangt der Geheimdienst, indem über ein Dutzend der zentralen US-Internetknotenpunkte von den großen US-Netzbetreibern angezapft werden.

Entsprechende Meldungen kursieren bereits seit Jahren und wurden durch die von Edward Snowden enthüllten NSA-Dokumente präzisiert. Die vom Wall Street Journal veröffentlichten Details verdeutlichen nun, dass der Internet-Traffic in den USA in einem größeren Ausmaß analysiert wird, als Regierungsvertreter bislang eingestehen wollen. So sollen in manchen Fällen auch die Inhalte von E-Mails oder Internet-Telefonaten von US-Bürgern in den NSA-Datenbanken gespeichert werden.

Die Informationen stammen allerdings nicht aus den Snowden-Dokumenten, sondern von anonymen Quellen aus den Reihen der NSA und der US-Administration. Hinzu kommen Mitarbeiter der Netzbetreiber, die an dem Aufbau oder Betrieb der Überwachungsprogramme beteiligt waren.

Die bereits vom Codenamen her bekannten NSA-Programmen wie Blarney, Fairview, Oakstar, Lithium und Stormbrew stehen für jeweils einen Netzbetreiber, der mit der NSA kooperiert. Laut dem Bericht des Wall Street Journal werden etwa mit Blarney die Datenströme von AT&T erfasst und analysiert. Als weiteres Unternehmen wird Verizon genannt, über das die NSA an den Datenverkehr aus Metropolen gelangen soll.

Offiziell überwacht die NSA den US-Traffic mit dem Ziel, grenzüberschreitende und ausländische Internet-Kommunikation zu erfassen, bei der ein nachrichtendienstliches Interesse besteht. Bei der Filterung sollen die Netzbetreiber zunächst nur Datenströme übermitteln, die nachrichtendienstlich „relevante“ Informationen enthalten könnten. „Es ist immer noch eine große Datenmenge, aber es sind nicht alle Daten der Welt“, sagte eine der Quellen vom Wall Street Journal.

Für einen kurzen Zeitraum wird der übermittelte Traffic von der NSA gespeichert, um die Rohdaten mittels komplexer Algorithmen nach relevanten Informationen zu durchsuchen. Auf diese Weise können bestimmte E-Mail-Adressen oder auch komplette IP-Adressblöcke von Organisationen und Staaten herausgefiltert werden. Mit Programmen wie XKeyscore können NSA-Analysten die Rohdaten allerdings auch gezielt „per Hand“ auswerten. In diesem Zeitraum kann sowohl auf Metadaten als auch auf Inhalte zugegriffen werden.

NSA-Überwachung von US-Bürgern rechtlich legitimiert?

Die Filterung dient allerdings auch dem Zweck, die rechtlichen Vorgaben zu erfüllen. Die abgefangenen Datenströme beinhalten neben ausländischer Kommunikation auch die entsprechenden Metadaten und Inhalte von US-Bürgern, die für die NSA an und für sich tabu sind. Für das Überwachen von US-Bürgern oder Personen innerhalb der USA ist jeweils ein Gerichtsbeschluss nötig, rechtswidrig erfasste Kommunikationsdaten müssen wieder gelöscht werden. Soweit die Theorie.

In der Praxis besteht für die NSA anscheinend ein wesentlich größerer Handlungsspielraum, um die Kommunikation von US-Bürgern auch ohne richterlichen Beschluss abzuhören. Infolge der Anschläge vom 11. September 2001 wurden die Rechte zur Überwachung innerhalb der USA ausgeweitet. Das berechtigt die NSA letztlich, auch Kommunikationsdaten von US-Bürgern in einem größerem Ausmaß zu sammeln, sobald ein Terror-Verdacht im Raum steht. Laut Paul Kouroupas, ehemals in Leitender Position bei Global Crossing, hängen die „Checks and Balances“ der NSA-Programme in erster Linie von den Netzbetreibern und den politischen Vorgaben der US-Administration ab: „Technisch und physisch verhindert nichts eine deutlich breitere Überwachung.“ Ähnlich äußerte sich bereits Edward Snowden in einem Interview mit dem Guardian.

NSA-Vertreter erklärten indes, die Programme wären legal und darüber hinaus so ausgelegt, dass die Privatsphäre von US-Bürgern respektiert werde. Außerdem habe der für Geheimdienst zuständige Gerichtshof FISC die Programme zugelassen und überprüft diese regelmäßig. Offizielle Vertreter der US-Administration haben zudem gegenüber dem Wall Street Journal bestritten, dass die NSA die Internet-Kommunikation von zahlreichen US-Bürgern abhören würde. Dass Daten von US-Bürgern versehentlich überwacht werden, soll sich möglichst auf ein Minimum beschränken. Die habe ausschließlich nachrichtendienstlich relevante Informationen im Visier.

Skepsis gegenüber offiziellen Aussagen

Solche Aussagen werden angesichts der jüngsten Berichte allerdings mit einer gehörigen Portion Skepsis begleitet. So belegen etwa am Mittwoch freigegebene FISC-Dokumente, dass die NSA zwischen 2008 und 2011 jährlich bis zu 56.000 Kommunikationsdaten von US-Bürgern rechtswidrig überwacht hatte. Im Oktober 2011 hatte der FISC die illegale Datensammlung beendet. Begründet wurde die fehlerhafte Überwachung von der NSA mit technischen Problemen, die laut einem Bericht der Washington Post mittlerweile behoben wurden.

Die US-Administration stellt die Veröffentlichung der Dokumente als Beispiel für die von Präsident Obama angekündigte Transparenz dar, die darüber hinaus zeigen, dass die NSA-Programme kontrolliert werden. Allerdings haben die zuletzt von der Washington Post veröffentlichten Dokumente verdeutlicht, dass der FISC in erster Linie den Aussagen der NSA vertrauen muss – überprüfen kann er diese nicht. Des Weiteren beschreibt das Wall Street Journal, dass etwa bei E-Mails nach wie vor technische Schwierigkeiten bestehen, anhand der Metadaten zu bestimmen, ob diese nun von einer Person innerhalb oder außerhalb der USA verschickt wurden.

Einen ebenso fragwürdigen Eindruck hinterlässt das NSA-Memorandum vom 9. August, in dem der Geheimdienst eigene Zahlen über den Umfang der Internetüberwachung verbreitet. Demnach berührt („touches“) die NSA bei der Auslandsaufklärung täglich 1,6 Prozent des globalen Traffics, laut der Rechnung von Ars Technica entspricht das 29,21 Petabytes. Zum Vergleich: Google verarbeitet rund 20 Petabyte pro Tag. Und die Datenmenge könnte bereits ausreichen, um den Großteil des Traffics abzudecken, der durch die zentralen US-Internetknoten fließt. Neben einigen weiteren Widersprüchen bei den von der NSA angegeben Werten liegt das Kernproblem in dem Begriff „touches“, der nicht näher definiert wird – und was letztlich die Aufklärung ad absurdum führt.