Cordesh

Lt. Commander

- Registriert

- Feb. 2011

- Beiträge

- 1.905

Das worauf der Professor bei seinem "ab einem gewissen Takt wartet die CPU nur noch..." hin will ist folgendes:

Datenübertragungen laufen max. mit Lichtgeschwindigkeit ab.

Das sind rund 300000 km/s (gerundet weils für dieses Beispiel ausreichend ist).

Würde eine CPU mit einem Takt von 1/s laufen, dürfte der Speicher aus dem Informationen abgerufen werden, und in dem die Programme liegen, also max. 150000 km (Lichtgeschwindigkeit/2 wegen hin und zurück) entfernt liegen, damit die CPU nicht "warten" muss.

Dabei sind jetzt mal Antwortzeiten des RAM's vernachlässigt.

Es geht rein um die Laufzeiten.

Wenn man nun einen Prozessor mit 2 GHz hat, wie weit darf dann der Speicher entfernt sein?

Nun: 300000(km) / 2.000.000.000 (Hz) / 2 (für hin und zurück)

= 0,000075 km, oder 0,075 m oder 7,5 cm.

D. h. also, ist bei einem Motherboard der Speicher mehr als 7,5 cm von der CPU entfernt, und die CPU läuft mit min. 2 GHz, so kann rein physikalisch gesehen die Entfernung des RAM's die Geschwindigkeit der Verarbeitung negativ beeinflussen.

Das Problem wird mit höheren Taktraten immer deutlicher.

Ich hab das jetzt nur mal so auf die Schnelle geschrieben, falls ich mich verrechnet haben sollte sorry. Es geht nur um das Prinzip das bei höheren Taktraten Entfernungen einen immer größeren Einfluß haben.

Daran ändern auch Busbreiten oder andere Massnahmen nichts.

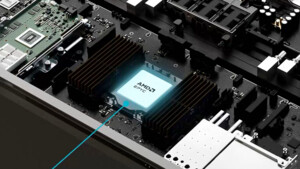

Man muss die miteinander kommunizierenden Bauteile näher aneinander rücken.

Datenübertragungen laufen max. mit Lichtgeschwindigkeit ab.

Das sind rund 300000 km/s (gerundet weils für dieses Beispiel ausreichend ist).

Würde eine CPU mit einem Takt von 1/s laufen, dürfte der Speicher aus dem Informationen abgerufen werden, und in dem die Programme liegen, also max. 150000 km (Lichtgeschwindigkeit/2 wegen hin und zurück) entfernt liegen, damit die CPU nicht "warten" muss.

Dabei sind jetzt mal Antwortzeiten des RAM's vernachlässigt.

Es geht rein um die Laufzeiten.

Wenn man nun einen Prozessor mit 2 GHz hat, wie weit darf dann der Speicher entfernt sein?

Nun: 300000(km) / 2.000.000.000 (Hz) / 2 (für hin und zurück)

= 0,000075 km, oder 0,075 m oder 7,5 cm.

D. h. also, ist bei einem Motherboard der Speicher mehr als 7,5 cm von der CPU entfernt, und die CPU läuft mit min. 2 GHz, so kann rein physikalisch gesehen die Entfernung des RAM's die Geschwindigkeit der Verarbeitung negativ beeinflussen.

Das Problem wird mit höheren Taktraten immer deutlicher.

Ich hab das jetzt nur mal so auf die Schnelle geschrieben, falls ich mich verrechnet haben sollte sorry. Es geht nur um das Prinzip das bei höheren Taktraten Entfernungen einen immer größeren Einfluß haben.

Daran ändern auch Busbreiten oder andere Massnahmen nichts.

Man muss die miteinander kommunizierenden Bauteile näher aneinander rücken.